世界模型开始做减法?LeCun团队和清华团队给出两种思路

文章摘要

【关 键 词】 世界模型、端到端训练、潜在空间、推理效率、物理结构

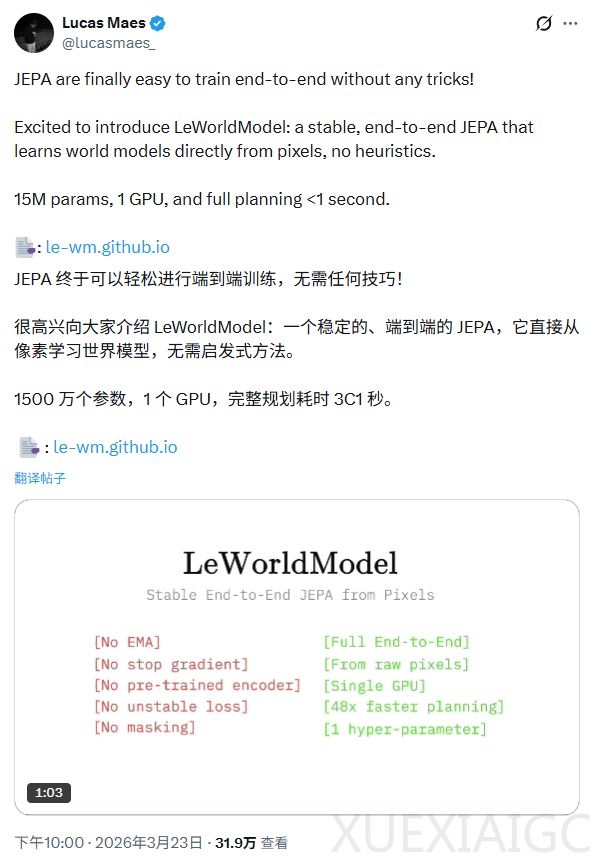

本文聚焦于世界模型研究中的两项重要进展,分别从建模简洁性与推理范式优化角度展开。LeWorldModel提出首个能从原始像素端到端稳定训练的JEPA模型,仅用两个损失项(下一步嵌入预测与高斯正则)即实现可训练的潜在动态系统;该模型参数约1500万,在单张GPU上数小时内完成训练,规划速度相较基线模型最高提升48倍,并在2D/3D控制任务中保持竞争力。更关键的是,通过物理量探测实验发现其潜在空间可编码有意义的物理结构,而“惊讶度”评估表明模型能可靠识别物理上不合理的事件。其架构由视觉编码器与动力学预测器构成,全程联合训练,无预训练依赖;决策阶段则直接在潜在空间内进行模型预测控制,构建出从输入到动作的完整闭环。

Fast-WAM则挑战主流WAM的“先想象再执行”范式,质疑显式未来生成是否必要。该方法设计核心在于区分训练与推理能力:保留视频协同训练以学习环境动态,但在测试阶段跳过未来视频展开与去噪步骤,转而直接输出动作。实验验证,只要训练中具备视频建模能力,即使测试时完全不进行未来想象,性能仍可媲美传统模型;而若移除视频协同训练,性能显著下降。该策略将高延迟的迭代生成环节大幅简化——推理延迟降至190毫秒,远低于现有方案(提速超4倍),已在LIBERO、RoboTwin及真实毛巾折叠等任务上取得优异表现,证明当前模型的关键优势不在于实时生成未来,而在于训练过程中对动态演化规律的高效捕捉。

综合来看,两项工作分别指向世界模型发展的两大方向:一是通过精简结构降低训练门槛,使复杂系统退化为最小可控闭环;二是重构推理机制,剥离冗余生成过程,强调“学习能力”的内在固化。二者共同推动世界模型从复杂模仿走向本质建模,既提升了实用效率,又深化了对“世界如何被理解”的认知基础。LeWM 仅约1500万参数,可在单张 GPU 上数小时内完成训练;相比基于基础模型的世界模型最高可提升约48倍;Fast-WAM 在无需具身预训练的情况下,在 LIBERO、RoboTwin 以及真实世界的毛巾折叠任务中均取得了具有竞争力的表现;只要保留训练阶段的视频建模能力,即使移除测试时的显式想象过程,模型性能仍能保持;反之,如果缺少视频建模能力,性能则会明显下降。

原文和模型

【原文链接】 阅读原文 [ 1874字 | 8分钟 ]

【原文作者】 机器之心

【摘要模型】 qwen3-vl-flash-2026-01-22

【摘要评分】 ★★☆☆☆