何恺明NeurIPS 2025演讲盘点:视觉目标检测三十年

文章摘要

【关 键 词】 人工智能、目标检测、计算机视觉、深度学习、技术发展

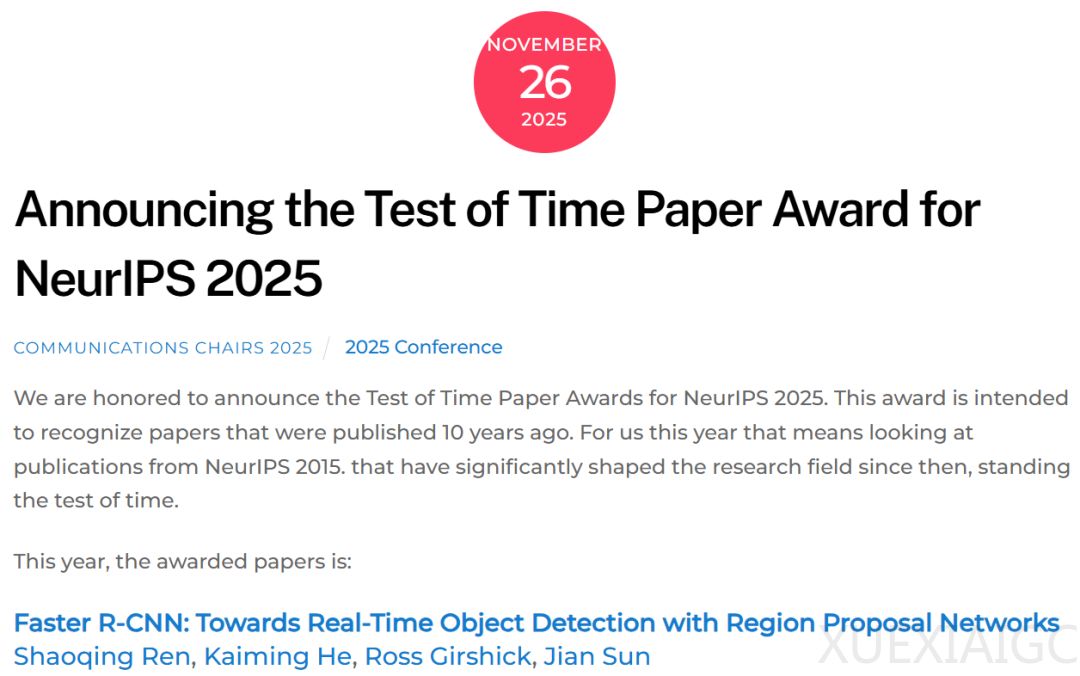

NeurIPS 2025会议上,由任少卿、何恺明、Ross Girshick和孙剑合著的《Faster R-CNN》论文荣获”时间检验奖”,这标志着该工作对计算机视觉领域长达十年的深远影响。作为现代目标检测框架的核心范式,该论文提出的方法深刻指引了视觉模型的发展方向。何恺明在会上以《视觉目标检测简史》为题,系统回顾了这一领域30年的演进历程。

早期目标检测主要依赖手工设计特征。90年代至2008年间,研究者先后开发了神经网络人脸检测、Viola-Jones框架、SIFT、HOG等代表性方法。特征工程黄金时代的DPM模型将物体视为可变形部件组合,成为传统方法的巅峰,但其依赖人工设计特征的局限性日益凸显。2012年AlexNet的突破证明了深度学习在特征提取上的优势,为检测任务带来新思路。

2014年R-CNN首次将CNN应用于目标检测,开创了基于区域提议的新范式。随后SPP-Net和Fast R-CNN相继优化了计算效率。2015年的Faster R-CNN通过引入区域提议网络(RPN),实现了完全端到端的实时检测,在速度和精度上取得双重突破。这项工作的核心价值在于:当传统组件成为瓶颈时,用可学习模型替代之。

后Faster R-CNN时代,技术发展呈现多元化趋势。2016年YOLO和SSD开创单阶段检测新思路,2017年Mask R-CNN扩展至实例分割,2020年DETR引入Transformer架构。2023年的SAM模型展示了视觉大模型的潜力。这些进展共同描绘出一个持续创新的技术图谱,其中每次突破都如同在迷雾中发现新大陆。

何恺明以”科学探索如同驶入迷雾”的比喻结束演讲,强调研究的前沿性和不确定性。Faster R-CNN的启示在于:突破性进展往往源于对传统范式的系统性重构。面向未来,计算机视觉领域仍有许多未知等待探索,而持续的技术创新将不断拓展机器感知的边界。

原文和模型

【原文链接】 阅读原文 [ 2057字 | 9分钟 ]

【原文作者】 机器之心

【摘要模型】 deepseek/deepseek-v3-0324

【摘要评分】 ★★★★★