文章摘要

【关 键 词】 AI技术、OCR创新、模型压缩、长文本处理、视觉编码

DeepSeek团队最新发布的DeepSeek-OCR模型突破了传统OCR的局限,将文字识别与结构化信息生成结合,实现了从图片到可编辑Markdown文档的端到端转换。该模型不仅能提取文字内容,还能自动识别标题层级,并将图表转化为可编辑的代码形式,显著提升了信息处理效率。与传统OCR仅输出纯文本相比,这种能力在金融报告等复杂文档处理场景中展现出巨大优势。

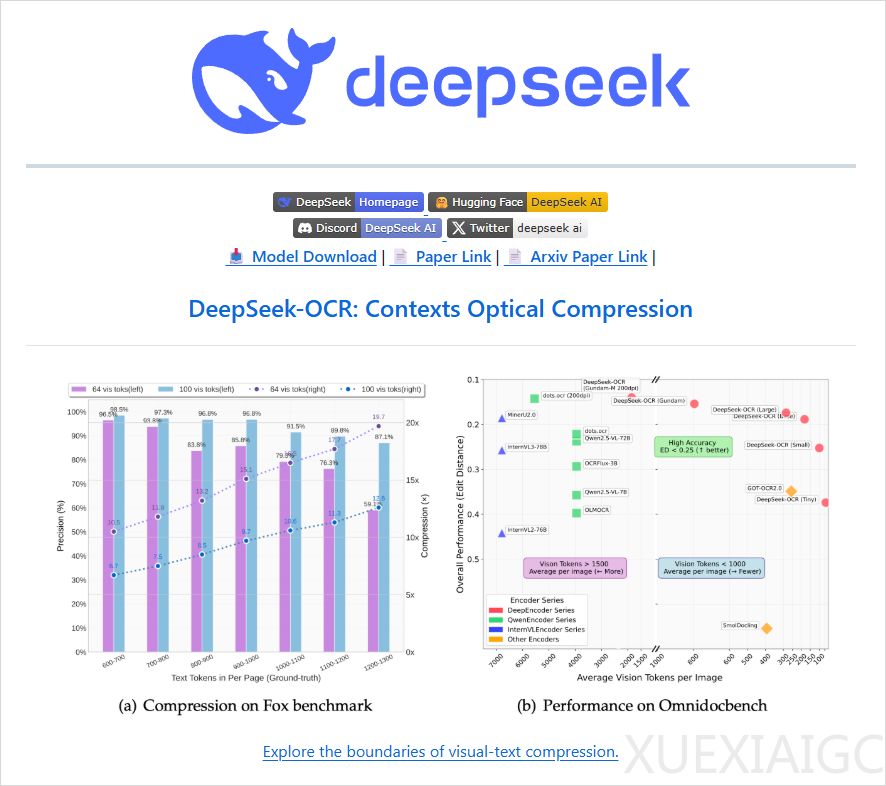

更革命性的是,该模型提出了“上下文光学压缩”技术,通过将长文本转化为视觉Token实现信息的高效存储。当前大语言模型面临的长文本处理瓶颈在于计算复杂度随文本长度呈平方级增长,而DeepSeek-OCR的解决方案是将历史对话记录渲染为图像并进行压缩存储,在保持96.5%准确率的情况下实现了10倍压缩比。这种机制模拟了人类记忆的衰减模式,近期信息保持高保真,而远期信息则通过提高压缩率自然模糊化。

论文中提出的渐进式压缩方案尤其引人深思。通过调整图像渲染精度控制信息保留程度,这种技术意外地复现了人类遗忘曲线的生物学特征。从进化视角看,这种设计暗合了人类认知系统的核心逻辑——选择性记忆与遗忘本就是智能的重要组成部分。该团队甚至探讨了这种机制在构建”数字生命”形态上的可能性,引发对AI本质的重新思考。

技术实现层面,模型采用570M参数的MOE架构DeepSeek-3B作为解码器,能够将视觉Token准确还原为原始文本。这种二维视觉编码相比传统一维文本处理,在信息密度和处理效率上展现出显著优势。虽然20倍压缩时准确率降至60%,但为后续优化指明了方向。从信息论角度看,这种方法回归了人类最原始的视觉信息处理方式,与古代壁画、象形文字等信息压缩手段存在有趣的跨时空呼应。

该项目已在GitHub开源,论文中透露的技术路线不仅解决了具体工程问题,更可能引发大模型架构设计的范式转移。当业界普遍聚焦于文本序列处理时,DeepSeek另辟蹊径的视觉编码方案,为突破Transformer架构的固有局限提供了全新思路。这种创新既包含实用的工程智慧,又蕴含着对智能本质的哲学思考,展现出中国AI团队在基础研究领域的突破能力。

原文和模型

【原文链接】 阅读原文 [ 2995字 | 12分钟 ]

【原文作者】 数字生命卡兹克

【摘要模型】 deepseek/deepseek-v3-0324

【摘要评分】 ★★★★★