文章摘要

【关 键 词】 流式视频、具身智能、实时推理、主动感知、智能调度

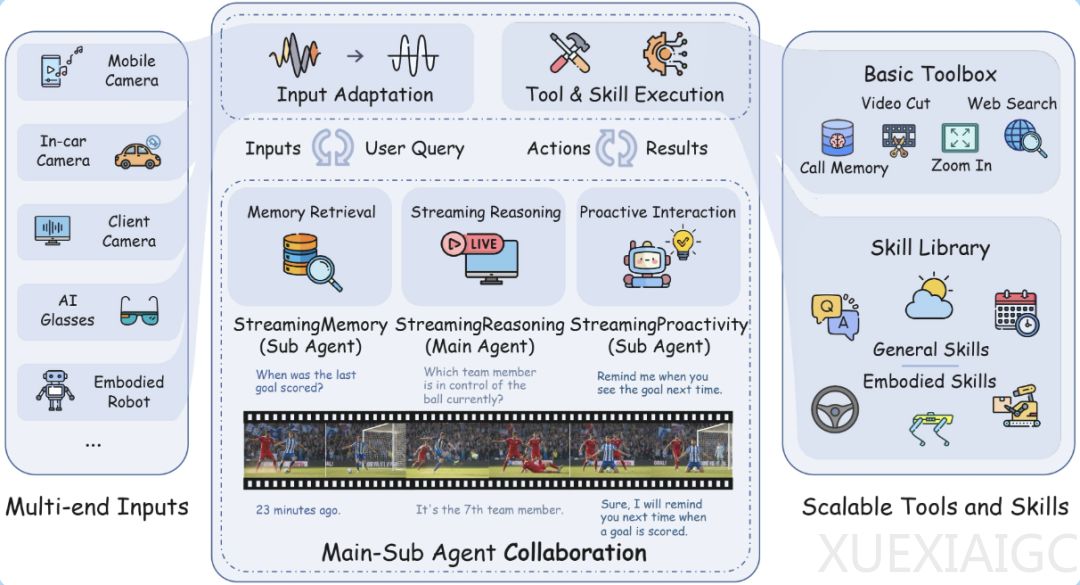

理想汽车推出了名为 StreamingClaw 的全新一代 Agent 框架,该方案深度集成了流式视频理解与具身智能的技术能力。此框架的核心创新点在于在保持与旧版通用标准兼容的同时,全面支持原生支持的实时的多模态流式交互。与传统的视频 AI 仅仅将视频视为离线文件进行处理的方式截然不同,New Architecture processes vision inputs as real-time streams rather than static files. This solves persistent delay issues. 该系统的硬实力集中体现在实时推理与瞬时响应两大特性上。 具身智能领域长期以来都面临着感知到执行的闭环延迟过大的挑战,尤其是在要求毫秒级响应的高端应用场景中。以往的处理方法常因长视频计算量爆炸而导致处理效率低下,且容易出现长时记忆的遗忘和逻辑断层。通过采用增量计算的替代方案,环境中的微小变化被转化为可更新的增量信号,系统因此在保持对上下文信息连续捕捉的同时,大幅降低了显存占用与计算浪费。在架构设计上,这一模型依托一套高度协同的多代理体系运作,利用标准化的流水线打通各类硬件间的数据传输。核心主代理负责整体的规划调度,辅助的主储记忆单元则提供持久的长链条逻辑支撑,而从属交互代理专门负责主动行为的触发与反馈。 借助自主的多代理调度机制,机器人在面临复杂指令时能独立完成任务规划与实际落地。

在具体运行机理中,流式推理引擎通过对视频流切分为细粒度片段来控制信息密度,并结合剪枝后的缓存策略确保解码节奏不卡顿。记忆模块则运用层级演化算法,将分散的视觉数据整合成高维度的经验知识,显著提升了关键内容的检索精度。此外,新增的主动交互组件能够在特定条件下自行判断并预警风险,形成了感推触发的安全闭环。虽然当前版本仍侧重于视觉与文本的基础输入范畴,未完全覆盖全类型的音频识别能力,但未来的演进路线已非常明确地指向统一全模态的大模型框架建设。最终目的是通过不断的算法迭代来实现跨越虚实空间的深度操控与交互。这种技术路径的转变标志着智能化终端在应对现实不确定性时的适应能力得到了质的飞跃,也让具身智能在自动驾驶及生活助手领域的实际应用成为了可能。

原文和模型

【原文链接】 阅读原文 [ 2392字 | 10分钟 ]

【原文作者】 量子位

【摘要模型】 qwen3.5-flash-2026-02-23

【摘要评分】 ★★☆☆☆