文章摘要

【关 键 词】 AIGC、大模型、智能体、技能进化、行为对齐

该系统提出一种无需微调模型参数的智能体自我进化新范式——Memento-Skills,核心在于构建一个动态演进的外部技能库,通过读写反思与“写日记”式学习实现持续能力跃升。系统放弃传统昂贵的参数微调路径,转而利用冻结的语言模型作为执行引擎,在不改变其内在结构的前提下,通过自主生成、修改与优化技能文件来提升任务表现。其闭环流程包括任务检索、执行反馈、故障归因与技能更新四个环节:面对新任务,智能体依据技能路由器从技能库中调取最匹配的工具序列;执行后基于环境反馈进行深度复盘,失败时精准定位问题技能并提出重构建议;当现有技能效能下滑至阈值以下,则触发更底层的技能发现机制,甚至从零合成全新技能模块,并经由自动单元测试验证后方可应用,避免系统性崩溃。

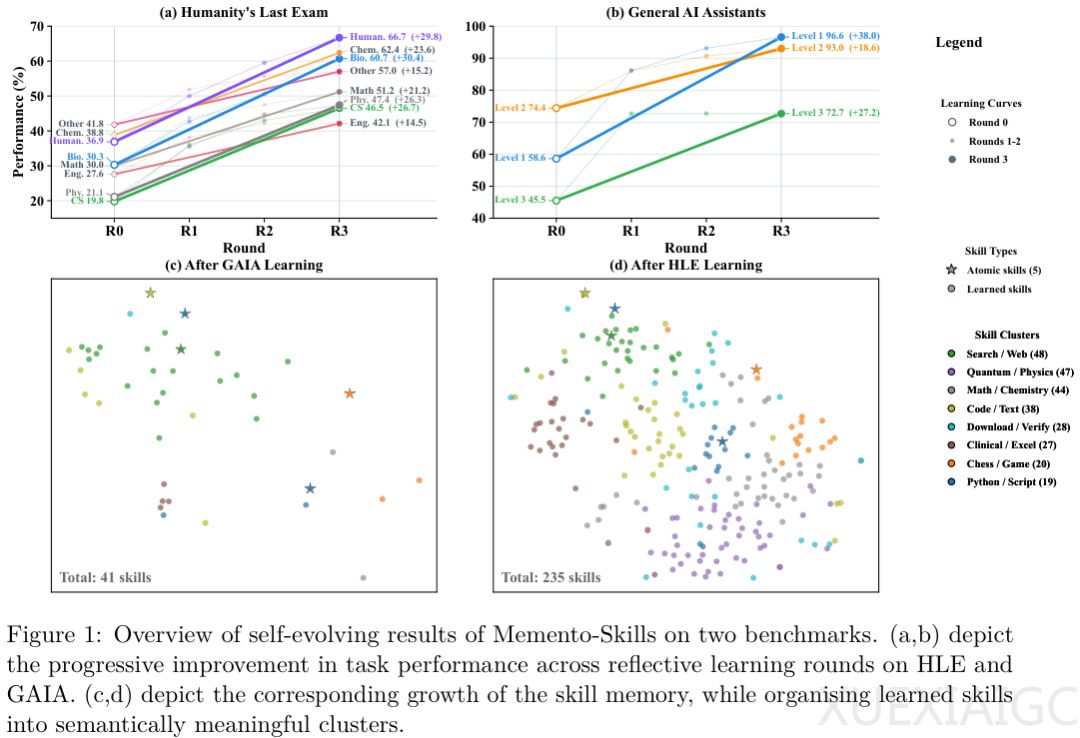

在行为对齐层面,系统采用单步离线强化学习框架训练路由模型,以InfoNCE机制引导语言模型学习区分高价值正向技能与低效负向技能,显著提升了技能匹配准确性。在140个合成查询上,其top-1召回率从基线模型的0.32跃升至0.6;在真实执行场景中,裁判打分成功率由50%提升至80%,验证了语义匹配不如行为信号有效。跨域迁移方面,研究团队在GAIA与HLE两大基准上验证了系统性能——GAIA整体准确率从65.1%提升至91.6%,测试集达66.0%;HLE总准确率从17.9%飙升至38.7%,人文学科及生物学领域尤为突出,分别达66.7%和60.7%。知识库物理形态随学习过程发生自组织演化:初始仅5个原子技能,经迭代扩展至GAIA的41个、HLE的235个,形成若干语义高度连贯的“技能星团”,支持跨任务迁移与领域泛化。

收敛现象分析表明,初期增长迅猛,后期增速放缓,源于技能库覆盖半径缩小与认知邻域收缩共同作用下的边际效益递减。为突破此瓶颈,研究者设计了三个可独立调节的优化旋钮:更换推理更强的底模以提升执行上限、扩大执行回合数拓展覆盖范围、升级向量嵌入架构以压缩检索误差。最终呈现出一种轻量级却高效的“写日记型”自我成长机制——未来智能体不再依赖算力堆叠,而是借由持续经验沉淀与策略重构,在低成本前提下实现能力跨越式发展。

原文和模型

【原文链接】 阅读原文 [ 2756字 | 12分钟 ]

【原文作者】 AIGC开放社区

【摘要模型】 qwen3-vl-flash-2026-01-22

【摘要评分】 ★★★☆☆