文章摘要

【关 键 词】 具身智能、VLA模型、模型设计、动作建模、性能跃升

随着大基础模型崛起,视觉-语言-动作模型(VLA)凭借继承的视觉与语言理解能力,为通用机器人策略学习提供了可扩展途径。但当前VLA研究领域仍处于“原始汤”阶段,充满了各种天马行空的探索和设计,但缺乏清晰的架构,且不同研究团队的训练协议与评估设置不一致,难以辨别哪些设计才是真正起核心作用的关键。为此,研究提出在统一框架与评估标准下,全面重新审视VLA的设计空间,系统性剖析并产出VLANeXt这一份实用的VLA模型设计“菜谱”。

研究从12个关键维度深度拆解VLA的设计空间,分为基础组件、感知要素、动作建模额外视角三大类逐一验证。在基础组件层面,发现解耦语言和行为空间的独立策略模块,效果优于直接复用文本token的动作分类方式,同时确定了深层策略建模、动作分块、流匹配损失函数、Qwen3VL-2B基座、柔性连接等有效设计方向;感知要素探索中,冗余的时序观察历史未带来性能提升,反而可能引入噪声,而结合第三人称和腕部视角的多视角输入,可提供互补的几何线索提升动作准确性,将本体感觉注入VLM端的融合效果最佳,且线性建模已能满足需求;动作建模视角下,出于训练效率考量未采用世界模型,引入离散余弦变换的频域对齐辅助损失,几乎不增加额外训练开销,却有效提升了动作预测效果。

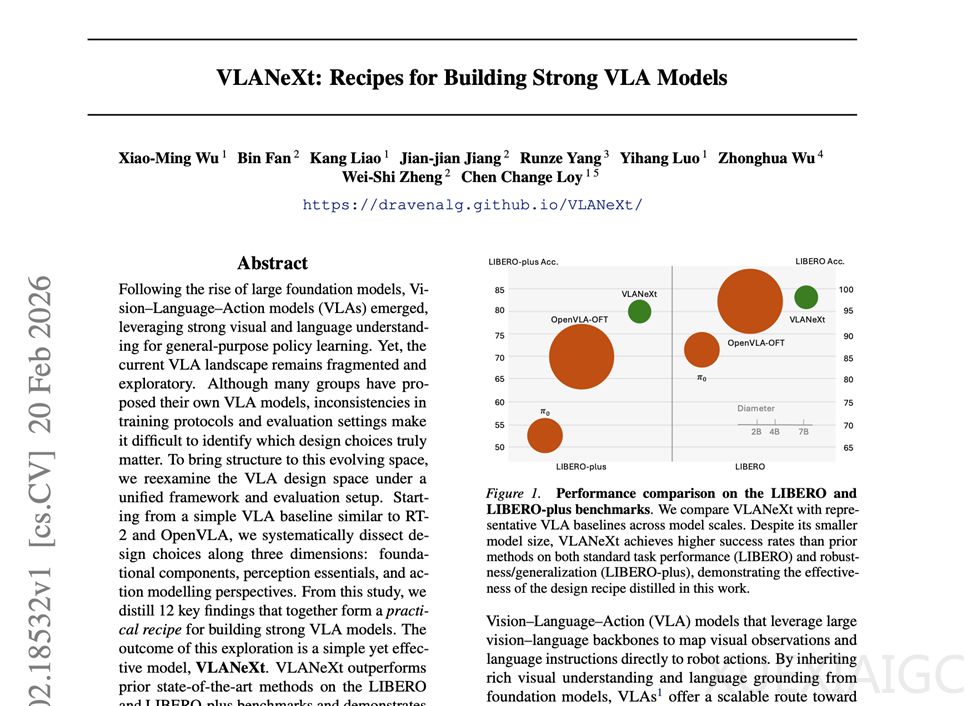

最终的VLANeXt模型在标准基准LIBERO及泛化性测试LIBERO-plus上,全面超越了包括7B参数模型在内的各类SOTA方法,面对未见过的光照、背景、相机位姿等扰动时,成功率较此前最佳方法大幅跃升10%。此外,该模型无需专门双臂预训练,就能在双臂协作任务中展现跨形态适应能力。这份设计“菜谱”覆盖从入门到进阶的需求,能为具身智能领域的从业者提供清晰的模型优化与构建方向。

原文和模型

【原文链接】 阅读原文 [ 2502字 | 11分钟 ]

【原文作者】 量子位

【摘要模型】 doubao-seed-1-8-251228

【摘要评分】 ★★★☆☆