文章摘要

【关 键 词】 技能基准、大模技能、效能增益、小模反超、领域差异

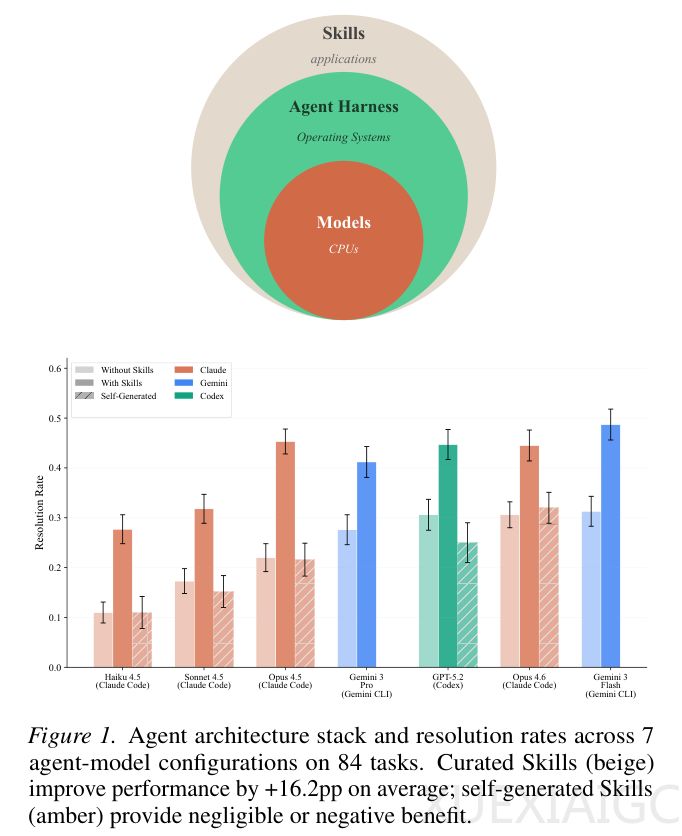

BenchFlow联合亚马逊、字节跳动等企业及多所顶尖高校,发布首个针对大语言模型Skills的测试基准SkillsBench,填补了行业缺乏Skills效果衡量标准的空白。该基准如同Skills用法指南,可清晰呈现Skills的增益、波动与翻车点。精心编制的专业技能操作手册能让模型处理复杂任务的成功率飙升16.2个百分点,小参数模型甚至能借此跨越算力鸿沟反超裸奔的大型旗舰模型。SkillsBench覆盖11个专业领域的84项复杂任务,测试7种主流模型配置并分析7308次运行轨迹,揭示核心结论:精心编制的专业Skills能大幅提升模型解决特定任务的能力,模型依靠自身生成的Skills往往适得其反。

Skills如同智能系统的大脑外挂,是为大语言模型量身定制的岗位操作手册,其设计借鉴现代计算机运作原理,让基础模型专注逻辑运算,外挂Skills提供专业领域标准操作程序,Skills完美融合了模块化封装与操作流程指导,在不同平台和模型间保持极高便携性。相较于提示词工程、检索增强生成技术,Skills能提供严密的程序化动作指导,而非仅补充事实或罗列接口。

为精准测量Skills增益,研究团队搭建完全容器化的沙盒环境,排除外部干扰,任务经自动化校验与多轮专家审查,确保Skills不包含特定任务的敏感信息,仅提供通用解决思路。测试发现,精选Skills能提升所有模型配置的表现,但收益因软硬件组合而异;模型自生成的Skills使平均成绩倒退1.3个百分点;Skills的效能与模型预训练阶段接触的领域数据呈现高度负相关,医疗、制造业等冷门领域模型成功率可暴涨超50%,软件工程等热门领域则可能因外部Skills打乱固有逻辑导致增益极小甚至反向影响。此外,Gemini Flash模型通过高频试错,在总成本降低44%的情况下取得最佳战绩。

Skills的投喂需遵循精简法则,外挂Skills绝非多多益善,过多无关模板会导致智能体认知过载,冗长指南会消耗上下文注意力,聚焦业务流拆解与精简案例的指引效果最优。高质量Skills还能打破参数规模壁垒,让入门级小模型在程序化任务中反超高端大模型。

原文和模型

【原文链接】 阅读原文 [ 2641字 | 11分钟 ]

【原文作者】 AIGC开放社区

【摘要模型】 doubao-seed-1-8-251228

【摘要评分】 ★★★★☆