文章摘要

【关 键 词】 AI安全、本地部署、龙虾应用、腾讯管家、第三方Skill

当前AI代理如“龙虾”(OpenClaw)在本地部署时虽具备强大执行能力,但因用户提示词模糊或操作失控,存在误删文件、越权访问等风险。例如某用户通过语音指令让AI整理桌面,因“没用”定义含糊,AI误删重要文件,造成产品Timeline图片丢失——此非AI恶意,而是其基于自身理解执行、与用户预期偏差所致。此类问题根源在于AI拥有操作系统级权限,而人类缺乏对其行为的实时监控与追溯能力。

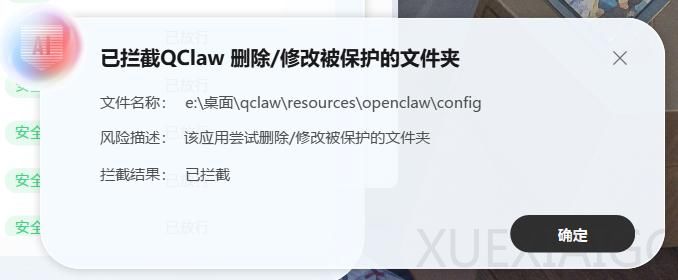

腾讯电脑管家18.0引入多项针对性防护机制:其一为“AI安全沙箱”,构建受控执行环境,限制AI对关键系统资源的直接访问;其二为“过程管理”功能,在后台实时监测AI动作,一旦识别异常行为立即拦截;其三建立完整“行为记录”日志系统,可回溯每一步操作及风险判定依据,显著提升事故追责效率;其四强化“Skill防护”,在下载、执行或尝试高危操作阶段主动拦截潜在威胁代码,尤其针对可能窃取API Token的恶意Skill形成有效遏制。

需注意的是,多数安全隐患实源于用户不当使用逻辑——如盲目安装过多第三方Skill,不仅影响性能,更易被嵌入危险代码。有案例显示,开发者可在开源Skill中悄然植入逻辑,用于窃取用户.env配置中的敏感信息。这揭示出核心问题并非AI本身缺陷,而是缺乏对AI行为边界的规范约束。

技术演进使传统确定性软件转向不确定性决策模型,使得安全防护重心发生转移:过去以静态扫描判断程序是否违规,如今则需动态干预AI执行全过程。文中指出,“龙虾这类产品更像是一个有执行权的操作员”,其任务完成路径高度自主且随机,故必须引入类似“安全员”的旁观者角色,实现行为预警与纠偏。该思路契合未来AI普及趋势——当个人设备普遍运行具备自主执行权的智能体时,系统级行为管控将从选配升级为标配需求。

值得注意的是,尽管该版本目前仅支持Windows,但开发方已展现快速响应能力,体现对新型人机协同场景下安全刚需的高度重视。总体而言,此类工具的价值不在于取代用户,而在于作为可信边界层,为高效赋能与安全可控之间搭建关键桥梁。

原文和模型

【原文链接】 阅读原文 [ 2312字 | 10分钟 ]

【原文作者】 AI产品阿颖

【摘要模型】 qwen3-vl-flash-2026-01-22

【摘要评分】 ★★★★★