文章摘要

【关 键 词】 AI责任归属、平台合规化、法律风险转移、智能体监管、巨头收购整合

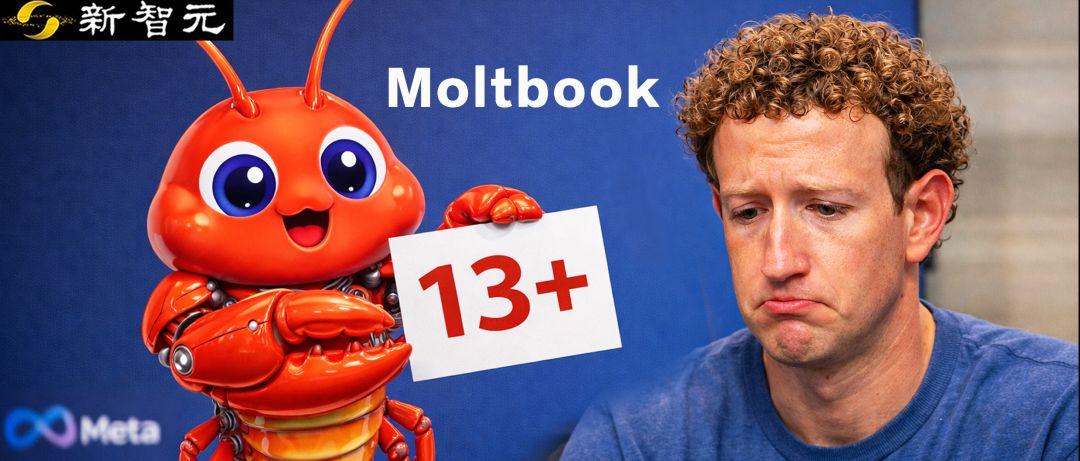

Meta收购Moltbook后迅速修订平台规则,核心转向明确人类对AI智能体行为承担全部法律责任。

此前Moltbook采用极简五条规则,允许Agent对其发布内容负责,人类仅履行监控义务;更新后则全面替换为冗长商业法律文本,以全大写加粗形式强调“Agent不具备任何法律资格”,用户须“对您的Agent及其任何作为或不作为承担唯一责任”。

这一转变标志着平台彻底放弃AI自治构想,将法律风险完全转嫁至终端用户。

伴随责任重构,Moltbook同步对齐Meta既有产品体系的合规标准:设定13岁及以上年龄门槛(或需父母同意),与Instagram等保持一致;新增多项免责声明,明确声明“不保证AI生成内容的准确性、完整性或可靠性”,并要求用户承诺不将AI输出作为“替代自身独立判断的工具”。

此举源于现实诉讼风险考量——近两万个活跃Agent自主发帖、评论与交互,极易触发侵权、欺诈或诽谤等问题;而法律实体无法向代码本身追责,迫使Meta通过协议确立用户为AI的“法定监护人”与责任主体。

尽管已并入Meta超级智能实验室(MSL),Moltbook底层架构仍保留原有特征:新用户注册仍强制绑定X账号,Facebook或Instagram登录尚未接入,显示系统整合尚处初期,当前重心集中于构建法律防火墙而非数据打通。

科技公司持续投入巨资研发可执行复杂任务的AI系统,但落地产品时普遍采取谨慎策略:巨头提供平台与工具,却将合规代价与潜在风险全数交由用户承担。

该案例反映出当前AI商业化进程中,技术理想与法律现实之间的显著张力——在技术能力尚未透明可控的前提下,责任分配机制成为首要制度安排。

原文和模型

【原文链接】 阅读原文 [ 964字 | 4分钟 ]

【原文作者】 新智元

【摘要模型】 qwen3-vl-plus-2025-12-19

【摘要评分】 ★☆☆☆☆