炸了!ICLR 一键清零 rebuttal,全网研究者怒了

文章摘要

【关 键 词】 学术争议、评审重置、社区反应、公平性质疑、机制反思

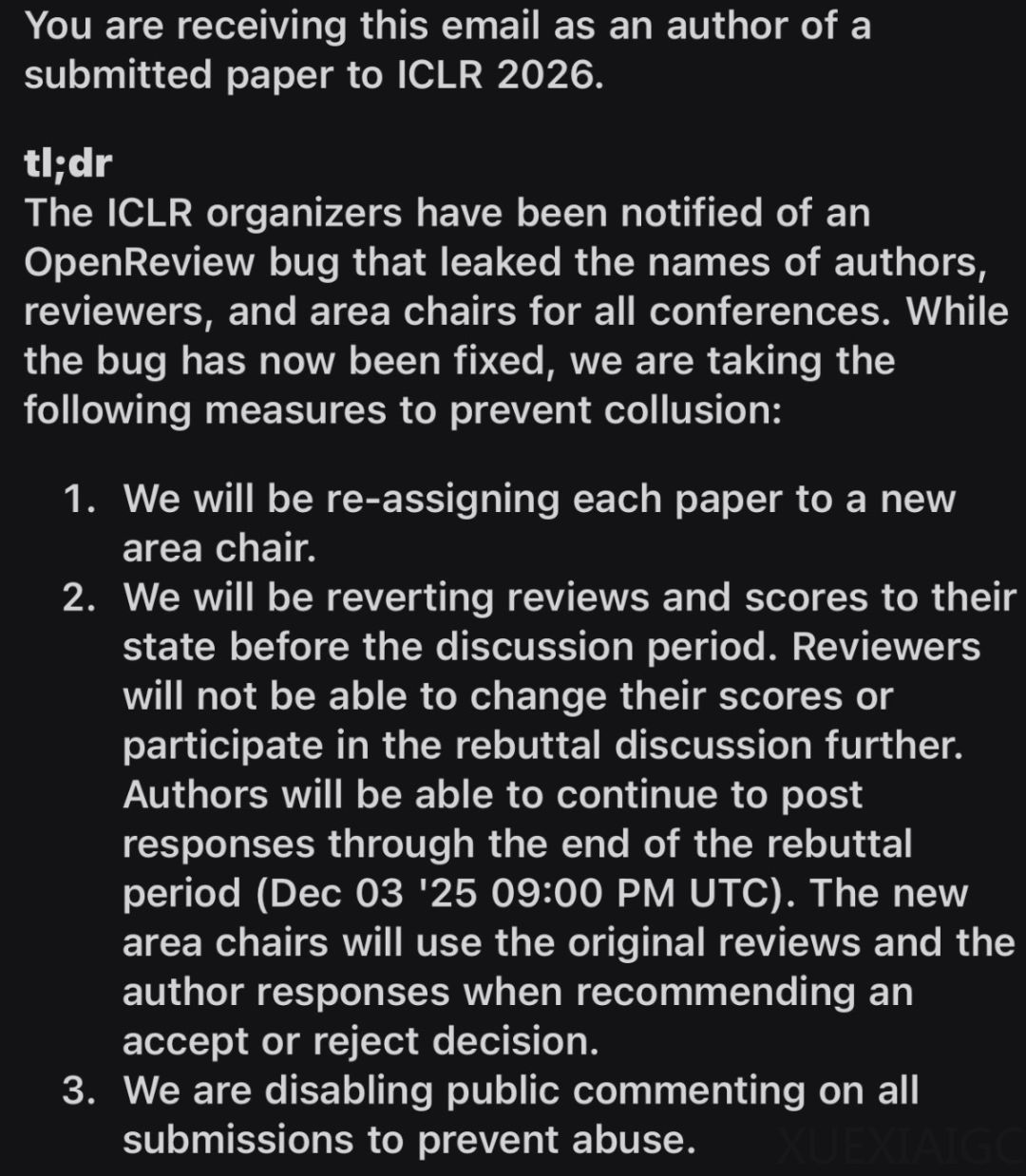

近期,ICLR(国际学习表征会议)因系统漏洞导致评审信息泄露,随后官方宣布将所有论文的审稿意见和评分重置至讨论阶段前的状态,并重新分配领域主席(AC)。这一决定在学术界引发强烈反响。许多作者表示,他们此前为反驳审稿意见投入大量精力,甚至通过补充实验成功提升评分,但重置措施使这些努力化为乌有。

争议的核心在于公平性。部分作者认为,此举是对未参与漏洞利用者的“连坐式惩罚”。他们质疑,主办方完全可以通过日志数据筛查异常行为,而非一刀切地清零所有评审进展。社交平台上,有人晒出邮件截图,显示原本通过rebuttal(答辩)将评分从4分提升至8分的论文被强制回滚,而新分配的AC可能因工作量激增(每人需处理数十篇论文)难以细致评估每篇论文的修改内容。

另一方面,也有少数作者认为重置可能带来意外公平。例如,此前遭遇审稿人无视rebuttal的作者,如今与其他论文回到同一起跑线。但更多声音指出,这一措施暴露了顶会评审体系的深层问题:投稿量暴涨(本届近2万篇)与审稿资源不足的矛盾日益尖锐,导致评审质量下滑。

ICLR官方解释称,重置是为防止漏洞继续被滥用,具体措施包括关闭公开评论功能、冻结审稿人修改权限等。但社区普遍担忧,临时更换的AC缺乏足够时间熟悉论文,可能依赖初始评分草率决策,进一步削弱评审可信度。Reddit等平台的热议显示,许多研究者对机器学习会议的“内卷化”感到悲观——追求论文数量而非质量的风气,叠加漏洞事件,加剧了学术界对现行机制的信任危机。

此次事件不仅是一次技术漏洞的善后,更成为审视学术评价体系的契机。从审稿人动力不足到AC超负荷工作,从rebuttal效力存疑到漏洞利用的道德风险,ICLR的“重启”暴露出系统性脆弱。尽管官方试图通过技术手段止损,但如何平衡效率与公平、透明与保密,仍是悬而未决的难题。

原文和模型

【原文链接】 阅读原文 [ 916字 | 4分钟 ]

【原文作者】 机器之心

【摘要模型】 deepseek/deepseek-v3-0324

【摘要评分】 ★★☆☆☆