文章摘要

【关 键 词】 算力短缺、芯片产能、台积电N3、内存瓶颈、AI需求激增

人工智能计算需求正经历爆发式增长,驱动代币使用量与模型部署规模持续攀升。

Anthropic在二月单月新增60亿美元年度经常性收入,主要源于智能体编码平台Claude Code的广泛采用,而其收入潜力受限于可用计算资源不足。

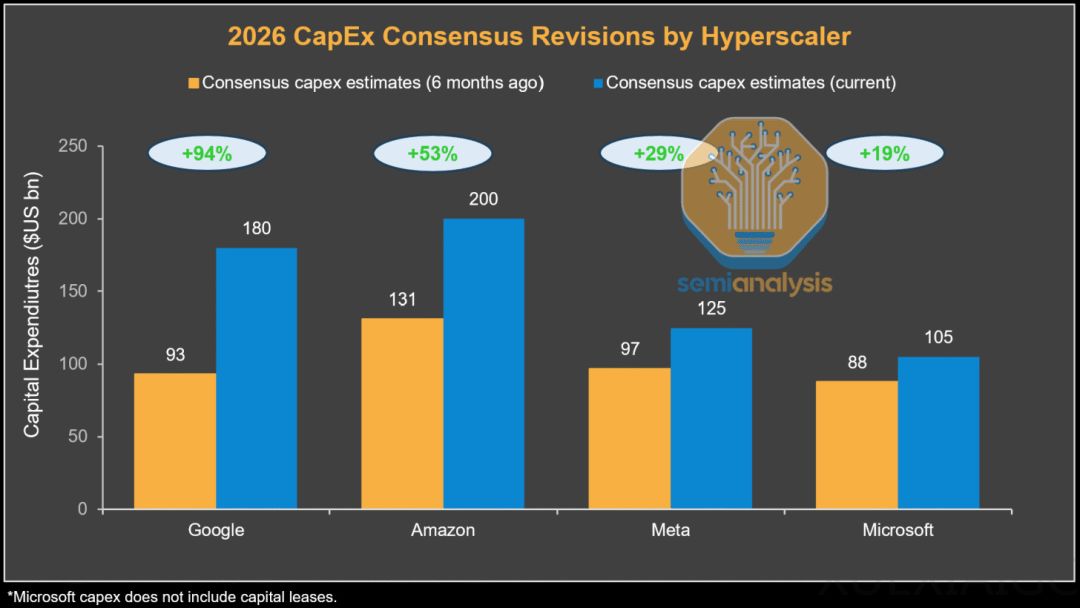

尽管全球数据中心资本支出大幅上调——谷歌2026年预期支出接近此前两倍——但核心制约已从电力、封装等转向硅基芯片制造能力本身,当前行业已全面进入先进逻辑芯片短缺阶段。

台积电N3工艺成为关键瓶颈:尽管N3E因成本优势被苹果、高通、联发科及英特尔广泛用于消费电子芯片,但至2026年,AI加速器将占据N3晶圆总产量近60%,并预计在2027年升至86%,彻底挤压消费类产能。

NVIDIA从Blackwell转向Rubin、AMD MI350X及MI400、谷歌TPU v7/v8、AWS Trainium3、Meta MTIA等主流AI芯片均计划或已采用N3系列工艺,叠加VR机架CPU、NVLink交换机等网络芯片需求,使N3晶圆供不应求。

台积电虽紧急提升资本支出并挖掘产线极限,但受制于洁净室空间限制,预计2026年下半年N3工艺有效利用率将超过100%,短期无法新增足够产能。

在此背景下,客户优先级发生结构性转移:AI基础设施客户凭借更高芯片尺寸、更复杂封装及更强付费意愿,获得远超手机与PC厂商的产能配额。

智能手机市场若出现需求疲软(出货量或同比下滑两位数),理论上可释放部分N3产能——例如转移5%晶圆开工量即可额外生产约10万颗Rubin GPU或30万颗TPU v7,但实际操作受限于内存与先进封装协同配套。

内存已成为继逻辑芯片后的第二大制约因素:HBM因每比特晶圆消耗量达普通DRAM三倍以上,且行业向HBM4/HBM4E升级进一步拉大差距,导致普通DRAM产能被持续挤占;同时AI加速器单芯片HBM容量快速提升(如Rubin较Blackwell提升50%,Rubin Ultra再增约4倍),叠加引脚速度要求提高(如11 Gb/s)带来的良率挑战,加剧供应紧张。

服务器DRAM需求亦同步攀升,VR NVL72机架DDR容量达Grace平台三倍,Vera CPU配置1536GB DDR。

若消费端DRAM出货下滑10%,仅释放约3%的全年总需求容量,不足以缓解整体缺口。

CoWoS封装限制则相对缓和,台积电策略上以N3前端产能为基准规划后道封装,且存在ASE、Amkor外包及英特尔EMIB等替代方案,部分缓解了2.5D封装瓶颈压力。

原文和模型

【原文链接】 阅读原文 [ 4294字 | 18分钟 ]

【原文作者】 半导体行业观察

【摘要模型】 qwen3-vl-plus-2025-12-19

【摘要评分】 ★☆☆☆☆