文章摘要

【关 键 词】 英伟达、机器人、具身智能、开源框架、代码策略

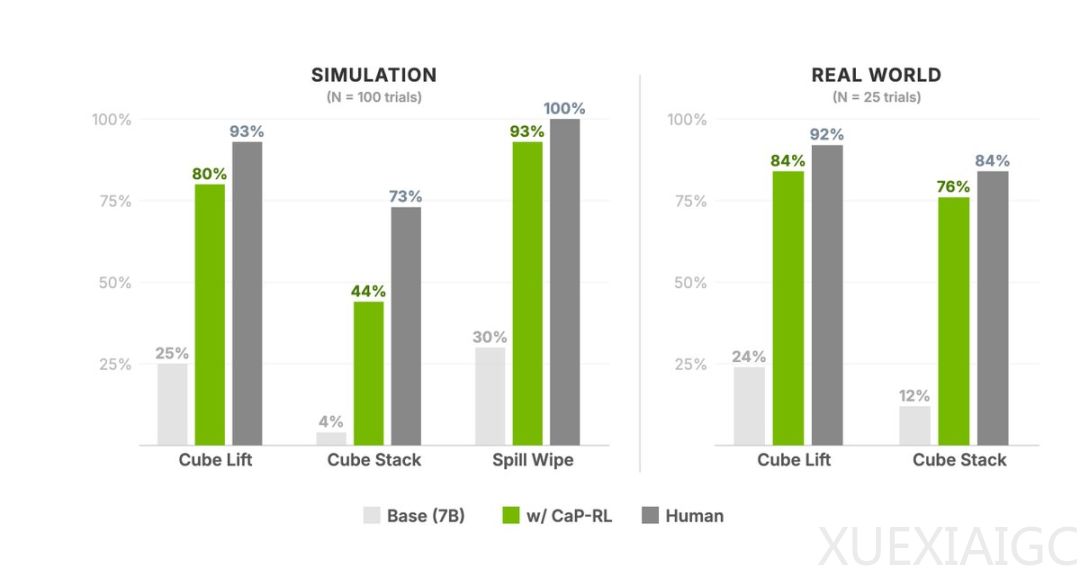

英伟达官方于近日公开了其新一代具身操控基础结构名为Capx,该平台致力于推动通用大模型与机器人物理控制深度的无缝融合。Capx技术架构允许机器人自主审视环境信息并将逻辑转换为可立即执行的源代码指令,彻底重构了底层动作执行链路。一旦某段脚本在运行过程中高效完成了规定目标,该段程序代码便会归档入库以便跨平台调派,无需针对不同形态机身重新适配。初步实验表明Capagent版本多项关键指标均达到了与职业选手手写规范相当的水平。相较于传统的预训练端到端大模型,此种依赖显性逻辑推理的方案展现出了更强且易于维护的操作鲁棒性与通用适应潜力,成功验证了程序化控制的理论前景。

在系统实现层面,研发团队构建了完整的软件栈以提供交互训练环境及配套的标准测试体系,涵盖感知抽象到运动规划的全过程支持。在具体操作上,它通过标准笛卡尔空间允许模型内进行直观的逻辑编排与碰撞预判,并通过多轮视觉差分分析引导代码纠错。CapGy整合了各类基础感知原语与动作指令包,使得模型能在统一接口下自主生成可运行代码,从而克服了因缺乏物理先验导致的低龄失效现象。 尽管针对单一视觉输入的误判可通过模块迭代得到修复,但目前纯代码控制尚未触及细微触觉敏感区的短板仍需解决。因此建议融合视觉语言动作专用模型分别处理宏观规划与微观落点的复杂协作需求。此举不仅解决了倒水插花等高频动作的不稳定性问题,也为低成本数据积累提供了新思路。重要的是,该方法论确认了强化学习搜索逻辑空间比依赖海量视频更能节约成本,且能直接零迁移应用。未来企业仅需维护业务层级代码即可适配多机型。具身智能的发展范式正在从大量数据依赖切换至逻辑推理增强驱动的演进路线,标志着智能机器人时代开启新的技术航道。

原文和模型

【原文链接】 阅读原文 [ 2741字 | 11分钟 ]

【原文作者】 量子位

【摘要模型】 qwen3.5-flash-2026-02-23

【摘要评分】 ★★☆☆☆