计算所程学旗团队:随机剪枝 AI 攻击策略,让对抗样本更具「通用攻击力」丨CVPR 2026

文章摘要

【关 键 词】 深度学习、对抗攻击、迁移攻击、对抗样本、RaPA

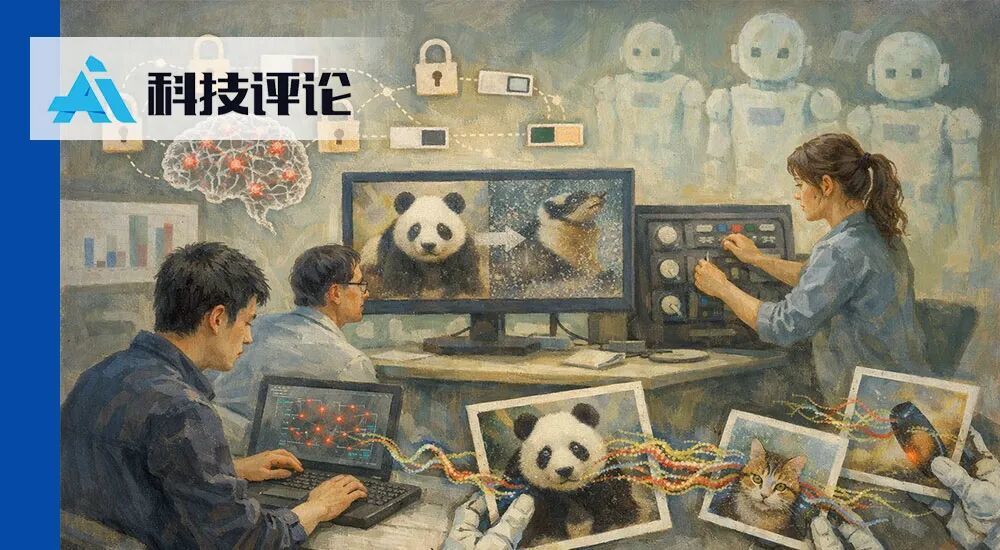

深度学习已广泛应用于自动驾驶、智能安防、医疗影像分析、智能终端等计算机视觉关键场景,但深度神经网络存在决策边界脆弱性问题,人类几乎无法察觉的微小输入扰动即可导致模型输出完全错误的预测结果,对抗样本问题成为深度学习系统面临的核心安全挑战之一。其中迁移攻击因无需访问目标模型的结构、参数或梯度信息,仅通过可访问的代理模型生成对抗样本即可攻击黑盒环境中的未知模型,在现实场景中具备更强威胁,是当前对抗攻击领域的研究热点。

现有迁移攻击方法生成的对抗样本往往过度依赖代理模型中的少量关键参数,导致样本难以适应其他不同的模型结构,限制了攻击在不同模型之间的泛化迁移能力。中国科学院计算技术研究所程学旗团队针对该问题提出全新对抗攻击方法RaPA,即随机参数剪枝攻击。该方法在攻击迭代过程中引入随机参数剪枝策略,每轮迭代随机暂时屏蔽代理模型的部分全连接层与归一化层参数,生成多个结构存在差异的模型变体,再整合所有模型变体的梯度信息做平均处理,以此更新对抗样本,最终得到泛化能力更强的对抗样本。该方法实现简单,无需重新训练模型,也不需要额外数据,还可与多种现有攻击技术结合,进一步提升攻击样本的迁移能力。

团队在统一控制实验条件的前提下,使用适配目标迁移攻击任务的ImageNet兼容数据集,覆盖卷积神经网络、视觉Transformer、CLIP等多种不同架构模型,与近十种当前主流的迁移攻击技术开展对比实验。实验结果显示,RaPA的攻击性能提升明显,在多数模型组合中的攻击成功率均达到或接近最高水平,跨架构攻击场景下优势尤为突出:在卷积神经网络生成对抗样本攻击Transformer模型的高难度任务中,RaPA将现有最优方法约33%的平均攻击成功率提升至约45%,使用ResNet50、DenseNet121作为代理模型时,攻击成功率分别提升约11.7%、17.5%;在Transformer生成样本攻击卷积神经网络的场景中,RaPA平均攻击成功率约为51%,高于所有对比方法。此外,在对抗训练模型、JPEG压缩等多种现有防御机制下,RaPA的攻击成功率仍然最高,且当计算资源增加时,RaPA的性能提升幅度远大于其他对比方法,攻击效果可得到进一步增强。

原文和模型

【原文链接】 阅读原文 [ 3424字 | 14分钟 ]

【原文作者】 AI科技评论

【摘要模型】 doubao-seed-2-0-lite-260215

【摘要评分】 ★★★☆☆