文章摘要

【关 键 词】 模型监控、灰盒检测、黑盒探测、模型调包、成本优化

在当前大型语言模型(LLM)广泛应用的背景下,API服务供应商可能出于成本或架构调整目的,在用户不知情的情况下更换后台模型,这种“隐秘调包”行为长期缺乏有效监管。法国研究人员提出两种新型检测技术,可在灰盒与黑盒两类不同访问权限环境下高效识别此类模型变更。第一种方法——对数概率追踪,适用于可获取单Token对数概率的灰盒环境;其核心原理是利用模型输出时对词汇表中各Token的对数概率分布作为“数字指纹”,任何权重微调、量化或结构变动都会导致该分布发生偏移。为排除硬件调度等噪声干扰,研究者设计了短提示词(如单字母“x”)与多次采样策略,并结合均值绝对距离及排列检验构建统计基准,从而区分真实模型变化与随机抖动。实验表明,该方法不仅将监测成本降至传统方案千分之一,且灵敏度极高——仅一个训练步数的微调即可被发现,在权重修剪压力测试中敏感度比现有主流方案高512倍。

第二种方法——黑盒边界输入追踪(B3IT),针对完全无法获取中间数据的黑盒场景开发。其理论基础在于模型决策边界的不稳定性:当输入提示词引发模型在多个候选Token间产生“相变式”犹豫(即多个Token逻辑得分相近),并在极低Temperature下进行采样时,微小参数扰动即会迅速打破概率平衡,使模型从随机采样转变为单一确定输出。研究人员通过低开销筛选机制(仅需3次重复采样验证Token多样性)快速定位关键边界输入,并在后续持续监测阶段,一旦观察到原分布中未出现的新Token或输出突变为唯一Token,即可判断后台模型已变更。该技术在黑盒环境下成本仅为同类最优方案的1/30,识别单步微调准确率达87%。

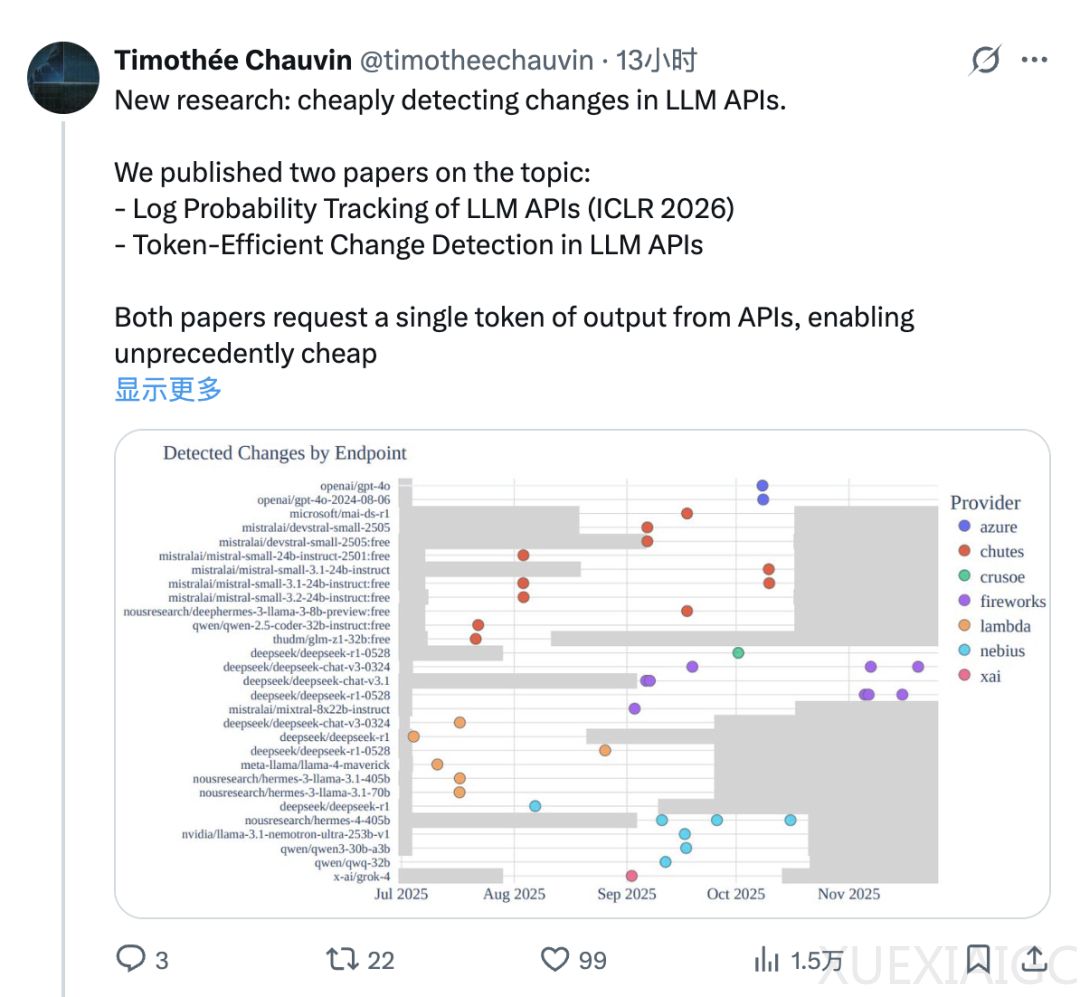

在真实世界应用中,这些工具揭示了大量现存问题:通过对189个API端点的长周期监测,共检出37次显著的概率分布异常,证实行业普遍存在模型替换现象;部分平台甚至在未公开声明下,将其标注型号悄然替换成架构迥异的其他模型,尤其以开源模型托管服务最为常见。对此,部分头部供应商尝试反制,如强制要求第三方请求必须生成至少16个Token,试图提高检测成本——但这也反过来证明,低成本检测手段已构成对服务商的实际约束力。两项技术为模型服务透明化提供了可行路径,也推动形成更严谨的模型审计标准与行业规范。

该技术能捕捉到仅经过一个训练步数微调所带来的模型特征演变,在针对模型权重修剪的压力测试中,该技术的敏感度达到了现有主流方案的512倍,黑盒边界输入追踪技术在黑盒环境下监测成本仅为现有最先进方案的1/30,研究者通过长期监测捕获到37次显著的概率分布偏移,揭示了行业内普遍存在的“模型掉包”风险。

原文和模型

【原文链接】 阅读原文 [ 2127字 | 9分钟 ]

【原文作者】 量子位

【摘要模型】 qwen3-vl-flash-2026-01-22

【摘要评分】 ★★★★☆