文章摘要

【关 键 词】 AIGC争议、代码审计、开源治理、技术伦理、开发范式

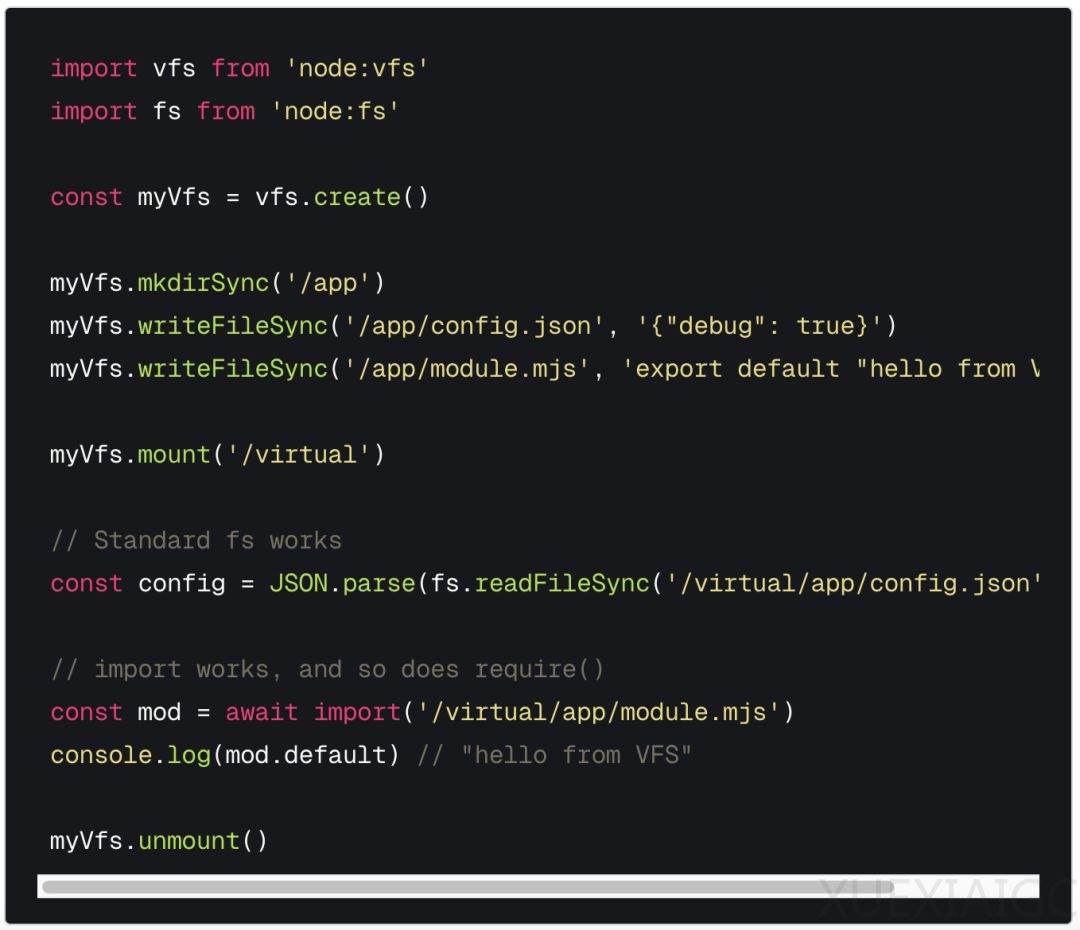

请愿方特别强调Node.js作为全球数百万服务器依赖的关键运行时环境,其核心代码须具备高度可追溯性与设计透明度;AI生成代码往往缺乏清晰的设计上下文,使评审从“理解决策”退化为“检查实现”,尤其在如此规模的变更下风险加剧。Collina则以“奶奶压面机”作比,强调最终责任仍由人类承担——他主导架构、设计API、逐行审核,并签署DCO。他呼吁建立对“人工审核”的新定义:评审者需能解释设计选择、独立回应反馈并维护代码一年后,而不仅是简单确认“已审查”。

多个权威机构已给出初步共识支持AI辅助贡献:Linux内核社区虽禁止AI添加DCO签名,但要求“Assisted-by”标签披露与严格人机循环;Red Hat法律团队与OpenJS基金会均确认DCO的核心在于问责制而非每行代码必由人类原创;前者明确指出,只要AI生成内容经人工披露、验证与署名,即符合DCO精神。社区讨论呈现两极分化:部分用户担忧AI生成代码不可复现、版权隐患及审查成本过高(估算19000行至少需90个工作日审阅),认为应优先使用可编程脚本如AST转换;另一些用户则认为核心维护者已深度介入,不应因工具使用方式而否定贡献价值。

项目创始人Ryan Dahl进一步推动这一思潮,直言“人类编写代码的时代已结束”,指出未来软件开发重心将转向协调AI工具以实现系统级构建,开发人员的新角色包括提示工程师、质量保证专家和集成架构师。他强调,价值转移至领域知识与问题解决能力——掌握React语法已远不如深入医疗或金融领域的专业知识重要。这暗示:当底层编码由AI高效完成,真正的专业能力正向更高维度演进,而如何平衡效率、安全与人文标准,将成为开源治理必须直面的长期命题。

原文和模型

【原文链接】 阅读原文 [ 3426字 | 14分钟 ]

【原文作者】 AI前线

【摘要模型】 qwen3-vl-flash-2026-01-22

【摘要评分】 ★★★☆☆