14B规模竟也能单卡实时生成视频?多亏这个强大的开源底座

文章摘要

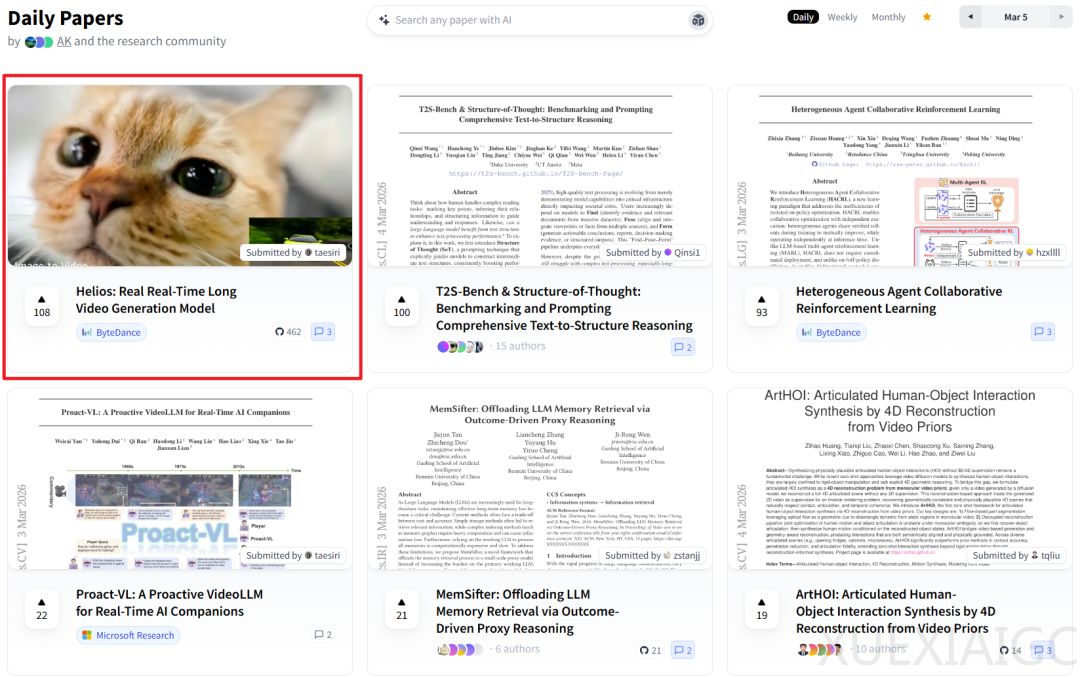

春节期间Seedance 2.0爆火推动视频生成领域关注度提升,字节跳动联合北大、安努智能、Canva开源具备实时生成能力的Helios视频模型家族,包含三个版本,全面覆盖文生视频、图生视频、视频转视频以及交互式生成任务。该模型以14B参数量实现单卡19.5FPS的生成速度,兼顾生成质量与速度,发布首日即实现昇腾NPU的Day-0级别支持,同步兼容多款主流推理框架,发布后不久便登顶Hugging Face Daily Papers,GitHub星标数已突破520。Helios核心开发团队为北京大学袁粒课题组,技术栈与该团队此前开源的Open-Sora Plan(OSP)高度同源,性能优于该团队此前基于UniWorld-OSP2.0开发的OSP-RealTime 14B,项目依托北京大学鲲鹏昇腾科教创新卓越中心的国产化算力支持落地。

当前AI视频生成社区已形成清晰共识,SOTA视频生成能力正快速向以Diffusion Transformer为核心的统一范式收敛,模型比拼也从基础画质的简单堆料,转向更高层级的语义理解深度与多模态协同效率,在此背景下袁粒团队推出UniWorld-OSP2.0。该模型是业界首个开源的超百亿级(21B)视频生成大模型,也是首个实现“昇腾原生&自回归+Diffusion混合架构”双原生统一范式的大模型体系,在VBench-I2V基准上的表现全面超越Wan2.1,在运动质量、图像保真度等指标上表现优异,整体进入开源阵营第一梯队。截至目前Open-Sora Plan累计获得约1.2万GitHub star、千万级下载量,已有字节跳动、腾讯WXG、阿里达摩院等多家国内外企业团队基于该框架开展二次开发。

UniWorld-OSP2.0采用因果变分自编码器、VLM增强多模态条件模块、扩散Transformer三大核心组件协同架构,针对I2V生成的条件图像泄漏行业痛点,提出FlashI2V核心机制,通过潜空间偏移与傅里叶引导的配合解决生成僵硬、泛化性差的问题;同时引入预训练VLM提取深层多模态特征,提升细粒度语义控制精度,还推出全新I2SV范式,可直接生成符合要求的风格化视频。基于该框架训练的OSP-RealTime 14B通过多项架构与工程优化,在单块昇腾Atlas A3上实现10FPS文生视频帧率,成为首个接近交互式视频生成的开源扩散架构,让视频生成具备商用规模化潜力。该项目依托昇腾底座打造了开源视频生成的公共基础设施,既为全行业节约了大量试错成本,也为国产化智算生态提供了高价值的工程落地参考,目前正向着通用视觉世界模型稳步演进。

原文和模型

【原文链接】 阅读原文 [ 4744字 | 19分钟 ]

【原文作者】 机器之心

【摘要模型】 doubao-seed-2-0-lite-260215

【摘要评分】 ★★★☆☆