3B打32B?海外病毒式传播的小模型,竟然来自BOSS直聘

文章摘要

【关 键 词】 小模型、大模型、推理能力、训练范式、模型部署

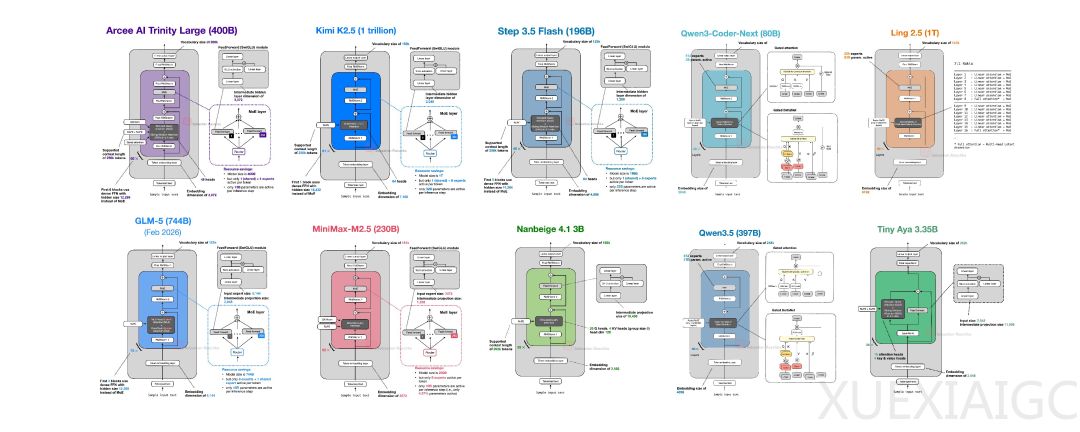

当前全球大模型行业陷入参数量军备竞赛,不论开源还是闭源阵营都在疯狂扩张模型参数规模,2026年初发布的开放权重模型中,已有多个万亿参数产品,小模型十分稀缺。但参数越大能力越强的行业共识早已摇摇欲坠,此前刷屏的“50米洗车是走去还是开车去”问题中,多个万亿级超大模型推理失败,一个3B参数的小模型却得出了正确结论,同时小模型在推理速度、部署成本上有着大模型无法比拟的优势。

BOSS直聘南北阁实验室推出的Nanbeige4.1-3B,验证了小模型实现越级性能的可能。Nanbeige4.1-3B是一款3B参数的通用小模型,评测结果显示它不仅显著超越同规模开源小模型,更在综合指标上超越参数量大10倍的主流大模型,即便和发布更晚的同级别Qwen3.5-4B相比也整体领先,发布后迅速登顶HuggingFace文本模型趋势榜,冲进全球模型总榜前三。该模型打破了小模型难以兼顾通用能力的刻板印象,核心突破在于将通用问答、复杂推理、编写代码、深度搜索Agent能力系统性整合进3B参数规模,通过分阶段分领域的优化策略平衡各领域能力。在训练中,SFT阶段通过调整数据分布、三阶段渐进扩展上下文到256K、升级思维链优化框架提升能力天花板,RL阶段拆分为Point-wise RL和Pair-wise RL分别提升回答质量与竞争能力,编码、深度搜索也分别采用针对性优化方案,实现了能力的高效压缩。

在排除数据记忆干扰的真实全新竞赛评测中,Nanbeige4.1-3B的表现不仅显著优于同规模Qwen3.5-4B,甚至超过了参数量更大的Qwen3.5-9B,充分验证了其极强的泛化能力与推理水平。该模型的出现证明,小模型不再只是大模型的轻量替代品,训练范式创新可以逐步弥补参数规模的差距,复杂推理、Agent能力等原本依赖大模型规模优势的能力开始下沉到部署友好的小模型,将重写企业部署范式,打开移动端、本地化、私有化部署的想象空间。当前大模型仍在扩张边界,小模型的效率革命也已开启,小模型的上限远未触顶,小模型时代正在加速启幕,未来决定AI应用广度的,可能是小参数模型所能释放的智能密度。

原文和模型

【原文链接】 阅读原文 [ 3534字 | 15分钟 ]

【原文作者】 机器之心

【摘要模型】 doubao-seed-2-0-lite-260215

【摘要评分】 ★★★☆☆