文章摘要

【关 键 词】 轻量模型、多模态统一、开源训推、推理编辑、文本渲染

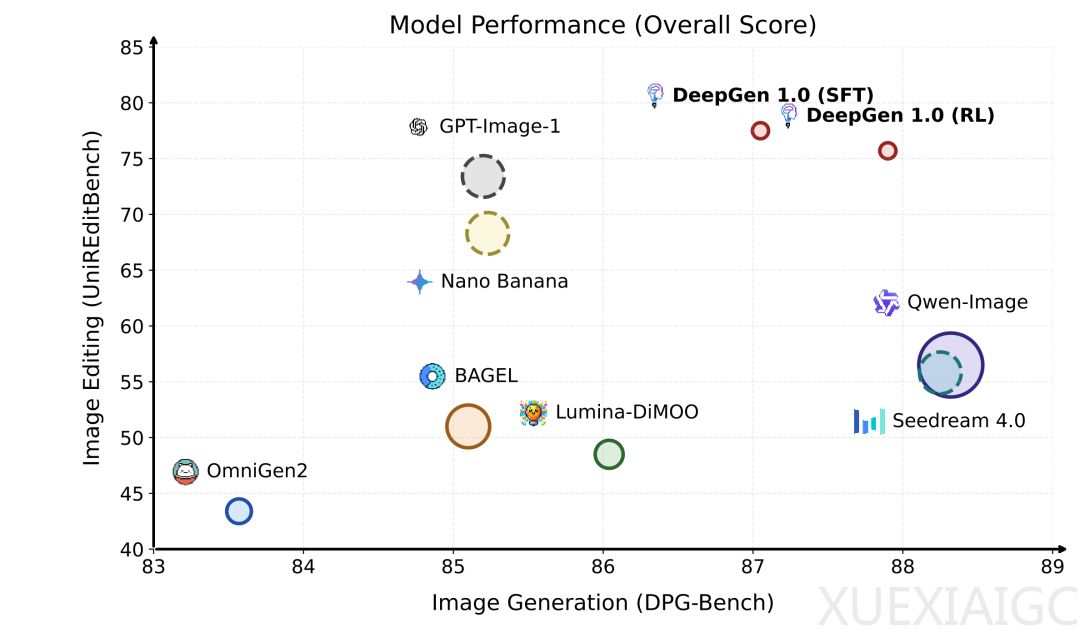

DeepGen 1.0是一个参数量为5B(含3B视觉语言模型VLM与2B扩散变换器DiT)的轻量级统一多模态生成编辑模型,旨在解决当前工业级模型参数庞大、部署成本高、功能割裂及开源资源匮乏等问题。该模型集成图像生成、图像编辑、推理生成、推理编辑与文字渲染五大能力,可在消费级硬件如RTX 4060 Ti 16G上实现约10秒内出图,且多项质量指标优于参数量达其4倍的工业级模型。其核心架构采用VLM-DiT双分支结构:VLM负责语义理解与世界知识建模,DiT在VLM引导下执行高质量图像生成;两者通过精简的encoder-based connector模块对齐特征,并借助堆叠通道桥接(SCB)实现跨层高效融合。关键创新在于引入可学习的隐式“Think Token”,作为轻量级思维链机制,在不显著增加参数的前提下缓解信息丢失与表示偏移,提升对复杂指令的推理能力。

训练流程分为三个阶段:首先预对齐connector模块,随后进行VLM与DiT的多任务联合微调,最终通过强化学习(RL)对齐人类偏好并增强文本渲染能力。为保障RL训练稳定性,团队提出MR-GRPO算法,混合使用pointwise与pairwise奖励模型,并融合三类互补奖励信号——VLM pairwise偏好奖励(评估图文对齐与视觉质量)、OCR奖励(优化文字识别准确率)与CLIP相似度(衡量整体语义一致性)。为防止长程训练中能力退化与图像网格化问题,MR-GRPO同时引入辅助SFT Loss作为结果引导、KL正则化作为过程引导:前者提供高质量输出监督信号以锚定模型行为,后者约束去噪轨迹偏离参考模型的程度;二者协同使RL训练稳定扩展至1500步,文本渲染能力提升10%,综合性能提升1.5%。实验证明,若去除辅助SFT Loss,模型在约300步后性能即开始崩塌,最终表现甚至劣于RL前基线。

模型训练数据整合真实世界样本、合成数据与精选开源集,覆盖通用与推理型生成/编辑任务,以及海报设计、人像生成等应用场景。团队全面开源全部训练与推理代码、各阶段模型权重及高质量数据集,支持从零复现与领域适配。该开源策略显著降低研究与应用门槛,使高质量统一多模态生成能力不再依赖大规模GPU集群,为端侧实时部署提供切实可能。作为填补“小模型、强能力”空白的关键进展,DeepGen 1.0推动统一多模态生成编辑模型走向开放协作与普惠落地。

原文和模型

【原文链接】 阅读原文 [ 1503字 | 7分钟 ]

【原文作者】 量子位

【摘要模型】 qwen3-vl-plus-2025-12-19

【摘要评分】 ★☆☆☆☆