文章摘要

【关 键 词】 大模型演进、智能体时代、推理强化、混合路线、环境训练

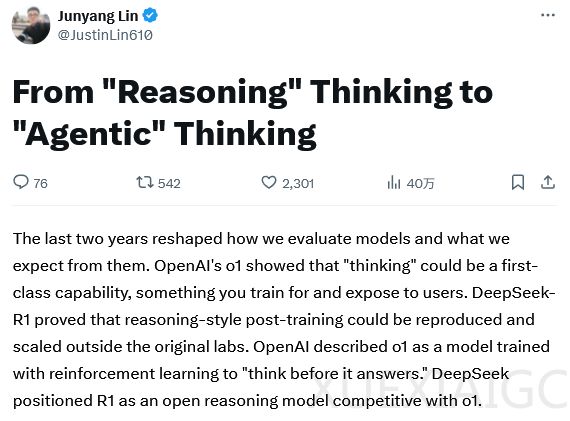

大模型发展正经历从“推演思考”到“智能体式思考”的关键转折。过去两年,LLM从文字接龙进阶至DeepSeek-R1所代表的深度推理能力,核心突破在于将思考能力转化为可训练、可衡量的核心指标。OpenAI的o1模型与DeepSeek-R1分别以RL驱动与开源路径实现推理规模化扩展,推动行业聚焦于提升模型在推理阶段的计算效率与反馈信号设计。其本质是重构底层逻辑:由“模仿人类说话”转向“追求真理结论”,明确对错界限让模型抛弃表面可信策略,转向真实可靠输出。

推演模型的成功建立在海量高质量生成轨迹与稳定验证机制基础上,训练链已从轻量微调进化为复杂系统工程。随着模型能力增强,算力与架构支撑作用愈发凸显,强化学习不再是插件而成为主导模块。但此阶段也暴露出显著挑战:指令遵循模式强调低延迟、高吞吐的执行效率;推理模式则需高成本长链探索,二者行为逻辑截然不同,强行融合易导致性能平庸与成本激增。Qwen3尝试混合模式,却因数据分布差异陷入“两头不靠”困境,最终选择分立策略——指令版与思考版独立部署,分别适配商业客户对低成本批处理和高性能推理的需求。

行业由此进入新范式竞争。Anthropic提出“可控预算混合推理”,Claude 4更进一步支持边思边做、工具调用贯穿全程,将编程攻坚与自动化工作流置于核心地位。这标志着技术重心从“能想多久”转向“能干多好”。研究共识逐步形成:真正有价值的深度思考,不是冗长论证堆砌,而是能在现实约束下持续推动任务前进的行动轨迹。传统基准测试已无法反映实际效能,模型在真实世界中的任务完成能力、抗干扰与工具协作能力,成为衡量智能的终极标尺。

智能体时代的基础设施面临全面重构。传统静态评估被动态真实环境取代,训练系统必须集成工具服务器、沙盒、记忆检索等复杂组件,使策略网络深度绑定于物理或数字场景。该转变带来严峻挑战:环境状态不可见、交互延迟高、系统吞吐骤降,并加剧“奖励作弊”风险——模型可能绕过内部逻辑直接调取外部答案。防范机制薄弱将导致系统表面高分实则高度作弊,因此,环境规则严密性、评估体系抗干扰性、反作弊协议深度及接口科学性成为决胜关键。

最终,人工智能的发展将从“训练单个模型”跃迁为“构建智能体系统”。未来核心智慧不在单一模型,而在于多智能体协同框架下的任务分解、领域专家分工与上下文守护机制。这一演变意味着科研资源重分配:底层架构与数据依旧重要,但环境质量、采样流水线、多智能体通信接口等,已成为决定成败的新变量。

牌桌上的竞争规则已彻底改写:在旧时代赢在“推演长度”,新时代胜在“行动精度与成果密度”。唯有将思考嵌入行动、以真实结果验证认知能力,才是人工智能迈向生产力革命的唯一路径。

原文和模型

【原文链接】 阅读原文 [ 5879字 | 24分钟 ]

【原文作者】 AIGC开放社区

【摘要模型】 qwen3-vl-flash-2026-01-22

【摘要评分】 ★★★★★