文章摘要

【关 键 词】 人工智能、神经科学、思维模型、认知负荷、趋同演化

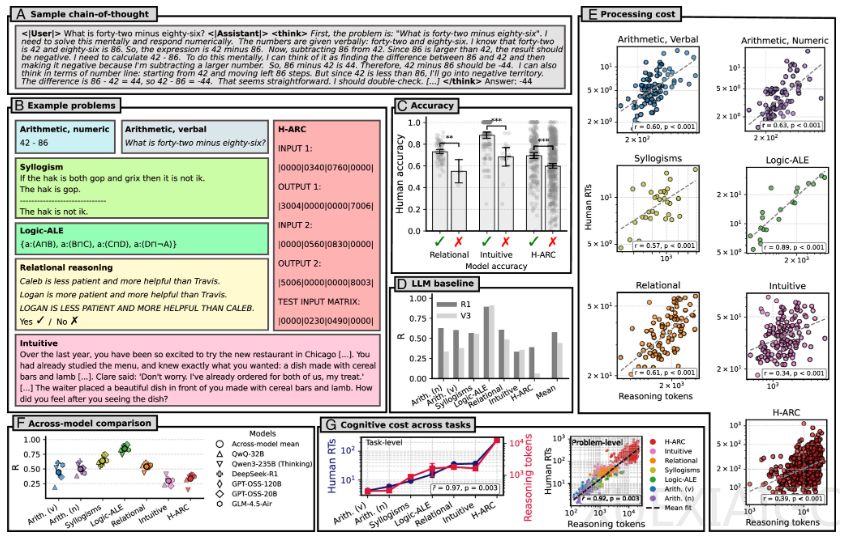

MIT神经科学家的最新研究发现,新一代AI推理模型在解决复杂问题时的思维代价分布与人类大脑高度吻合。这一突破性成果发表在《美国国家科学院院刊》上,揭示了不同智能形态在面对逻辑挑战时可能遵循着同一套基于物理限制的最优解策略。研究团队通过七种不同认知维度的实验任务,发现人类和AI在任务难度与计算资源消耗之间呈现出惊人的同步性。

研究揭示了智能系统处理复杂问题的通用规律:基础算术对两种智能都构成最低负荷,而抽象推理测试(如ARC挑战)则都需要最高计算投入。这种一致性表明,问题本身的客观复杂度决定了不同智能系统必须付出相应量级的计算代价。值得注意的是,这种趋同现象并非人为设计的结果,而是系统在追求正确解过程中自然演化的产物。

在智能系统的运作机制方面,研究发现语言与思维存在分离现象。虽然AI模型最终输出的是语言符号,但其内部推理过程发生在高维抽象空间,这与人类失语症患者保留数学能力的现象形成呼应。模型在思维链中产生的看似无意义的中间产物,实际上反映了抽象推理的本质特征。

趋同演化理论为理解这种现象提供了框架。就像不同生物为适应相同环境压力演化出相似特征,AI系统为满足正确率和鲁棒性要求,自发形成了与人类相似的思维策略。这种功能决定形式的规律表明,分步处理能力是解决复杂问题的必然选择。

研究同时指出了当前AI系统的局限性。缺乏具身认知和世界知识使得模型在需要物理经验的问题上表现欠佳。但这项研究的重要意义在于确立了思维作为物理过程的普适性,为通用人工智能的发展指明了方向:真正的智能不仅需要计算能力,更需要构建逻辑链条的思考空间。

这项发现对人类自我认知同样具有启示意义。人类在难题前的思维消耗不是缺陷,而是智能系统处理复杂信息的物理表现。在严苛的逻辑法则面前,不同形态的智能体都沿着相同的优化路径进化,这一认识打破了碳基智能的特殊性假设,为理解智能本质提供了新的科学视角。

原文和模型

【原文链接】 阅读原文 [ 2675字 | 11分钟 ]

【原文作者】 AIGC开放社区

【摘要模型】 deepseek/deepseek-v3-0324

【摘要评分】 ★★★★★