OpenClaw带火AI记忆,DeepMind用混合记忆把3D重建拉到近2万帧

文章摘要

【关 键 词】 长时记忆、3D重建、混合架构、前馈推理、尺度稳定

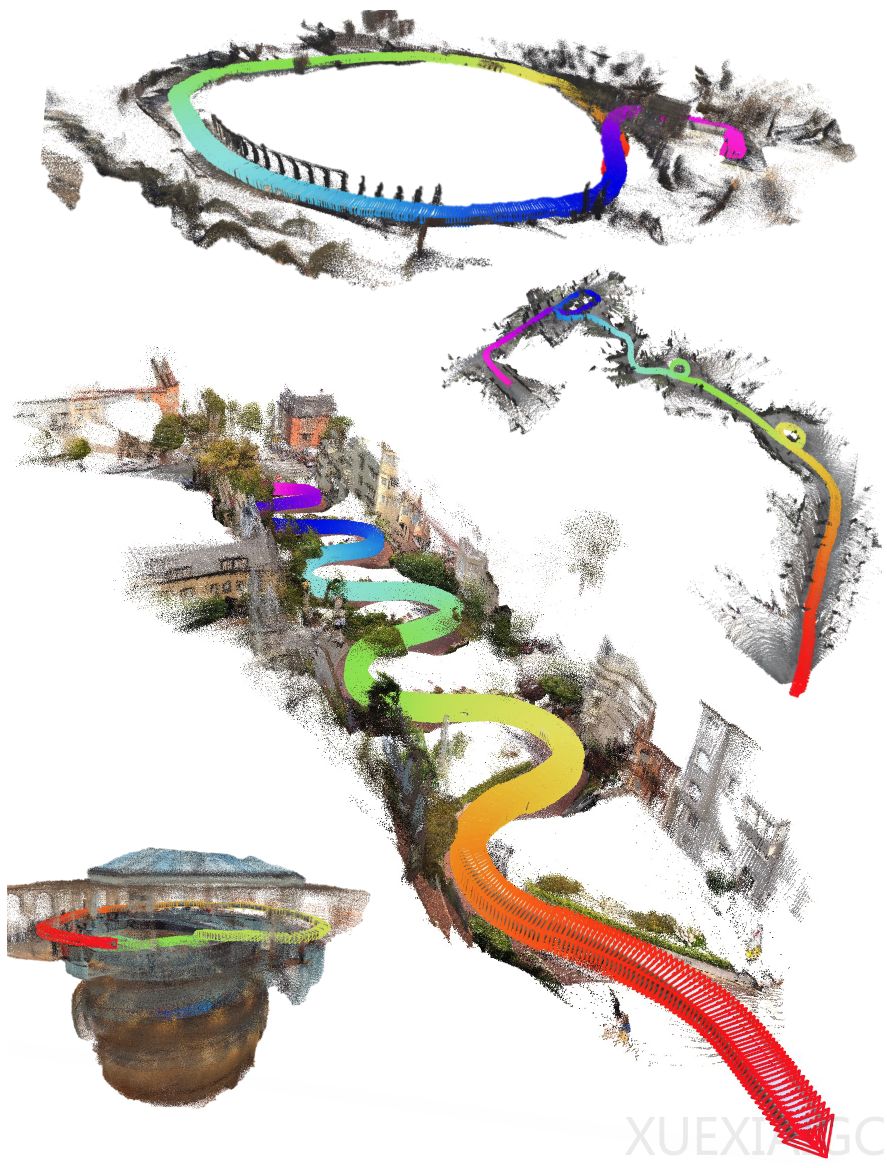

谷歌DeepMind与加州大学伯克利分校合作提出的LoGeR(Long-Context Geometric Reconstruction)旨在解决前馈式3D重建模型在处理超长视频序列时的两大核心瓶颈:架构层面的上下文壁垒与训练数据层面的数据壁垒。现有前馈模型受限于双向注意力机制的二次时间复杂度,通常仅能在几十至百余帧的短时窗口内操作;同时,训练数据多集中于短序列“气泡”,导致模型无法泛化至数千甚至上万帧的真实长视频场景。为突破该限制,LoGeR采用分块顺序处理策略,在保证局部高保真几何推理的前提下,引入一种双组件混合记忆模块以维持跨块一致性。

该混合记忆系统由两部分协同构成:一是参数化的测试时训练(TTT)记忆模块,通过动态更新快速权重集W,实现对全局坐标框架的锚定与尺度漂移的抑制;二是非参数化的滑动窗口注意力(SWA)机制,在相邻块边界处无损传递高保真特征,确保细粒度几何对齐。TTT提供可扩展的长距离有损记忆,而SWA保障短距无损信息流动,二者互补形成高效且稳定的跨块信息通路。为进一步提升全局一致性,LoGeR额外集成纯前馈对齐步骤,使预测结果严格对齐统一坐标系,防止长期误差累积

针对训练中的“数据壁垒”,研究团队构建了侧重大规模场景的数据集(如TartanAirV2),并设计渐进式课程学习策略:从48帧序列、4块起步,逐步增至128帧、20块,引导模型从依赖SWA过渡至充分调用TTT隐藏状态。实验表明,LoGeR在KITTI基准上将绝对轨迹误差(ATE)较先前前馈方法降低超74%,其平均性能甚至优于当前最优的优化类方法VGGT-Long达32.5%;在含最多19000帧的VBR数据集上,LoGeR仍能维持稳定全局尺度,而基线方法出现显著尺度漂移。在长达2万帧的超长序列中,LoGeR实现了稳健的回环闭合与大尺度结构保持,验证了其前馈架构下扩展至分钟级视频重建的可行性。此外,在7-Scenes、ScanNetV2与TUM-Dynamics等短序列基准中,LoGeR亦全面超越Point3R、CUT3R、TTT3R及StreamVGGT等亚二次复杂度方法,证明其在重建质量与位姿精度上的综合优势。

原文和模型

【原文链接】 阅读原文 [ 2672字 | 11分钟 ]

【原文作者】 机器之心

【摘要模型】 qwen3-vl-plus-2025-12-19

【摘要评分】 ★★★☆☆