文章摘要

【关 键 词】 智能体、AI安全、开源框架、隐私保护、安全架构

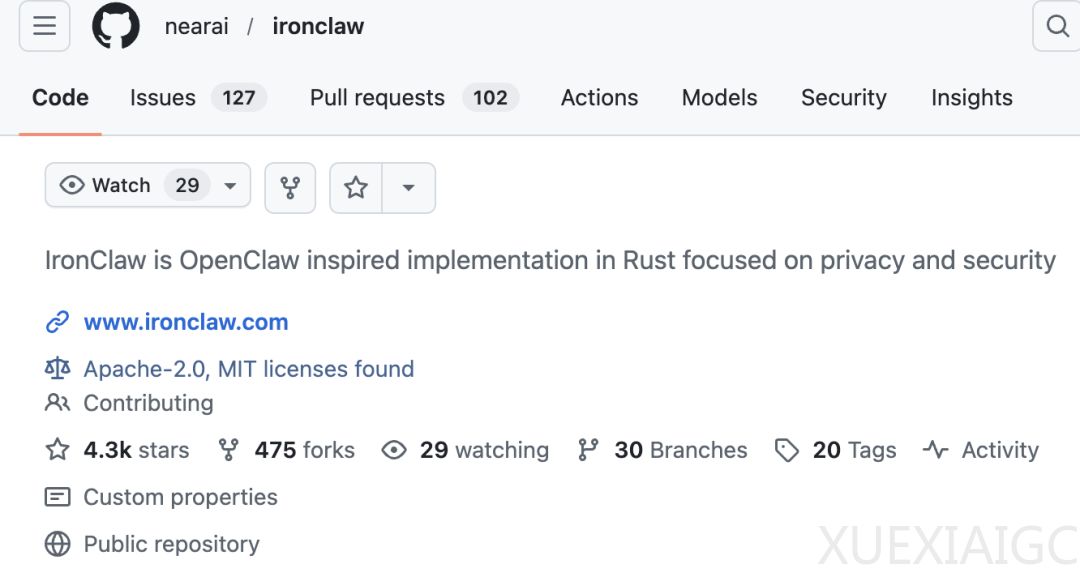

原本热门的AI智能体框架OpenClaw存在严重安全问题,其架构设计存在原生缺陷,用户的邮箱凭证、API密钥等敏感信息会直接送入大语言模型提供商的服务器,用户所有个人及雇主数据,哪怕未明确授权的信息,都可能被服务商员工访问,同时还存在一键式远程代码执行、提示注入攻击、恶意技能窃取密码等诸多漏洞。目前超过25000个缺乏充分安全控制的OpenClaw公开实例暴露在互联网中,被安全专家称为安全灾难。Transformer的共同作者Illia Polosukhin作为OpenClaw的早期使用者,认可其改变了人机交互方式,但认为便利不能以个人和雇主的安全隐私为代价,因此从零重构了安全版本的AI智能体框架IronClaw。该项目现已在GitHub开源,提供macOS、Linux、Windows多系统安装包,支持本地部署与云端托管,目前处于快速迭代阶段,已有可用版本开放下载。

IronClaw采用Rust语言完全重写,建立了四层纵深防御安全架构,这套设计中最关键的一点是大模型本身永远接触不到原始凭证,只有当智能体需要与外部服务通信时,凭证才会在网络边界被注入。四层防御分别为:Rust语言自带的内存安全保证,可从根源消除缓冲区溢出等传统漏洞;WASM沙箱隔离,将所有第三方工具与AI生成代码限制在独立容器内运行,严格控制恶意代码的破坏范围;采用AES-256-GCM加密存储的凭证保险库,每条凭证都绑定限定使用范围的策略规则;依托硬件级隔离的可信执行环境,即使云服务商也无法访问用户的敏感信息。即便大模型被提示注入攻击试图向外发送用户凭证,凭证存储层也会直接拒绝请求、记录日志并向用户发出警报。

针对社区担忧IronClaw走红后是否会重蹈OpenClaw的覆辙,Illia Polosukhin回应称架构已从根本堵住了OpenClaw的核心漏洞,待核心版本稳定后,团队还将开展红队测试与专业安全审查。对于提示注入这一业界公认难题,目前IronClaw采用启发式规则检测,未来计划部署可持续更新的小型语言分类器识别攻击模式,应对这类攻击仍需更多研发,欢迎社区贡献方案。部署层面,纯本地部署存在设备离线就停止运行、移动端能耗过高等局限,机密云是兼顾隐私保障与持续运行需求的最优折中方案,还支持用户自定义安全策略,例如跨境旅行时自动添加额外防护。IronClaw是NEAR Protocol“用户自有AI”战略的核心运行时层,该战略愿景为让用户完全掌控自身数据与资产,目前已经搭建了AI云平台、去中心化GPU市场、智能体雇佣市场等配套基础设施。AI智能体是人类与线上一切交互的终极界面,发展的同时必须把安全做好。

原文和模型

【原文链接】 阅读原文 [ 1807字 | 8分钟 ]

【原文作者】 量子位

【摘要模型】 doubao-seed-2-0-lite-260215

【摘要评分】 ★★☆☆☆