文章摘要

【关 键 词】 AI模型、多模态、文档解析、OCR技术、开源项目

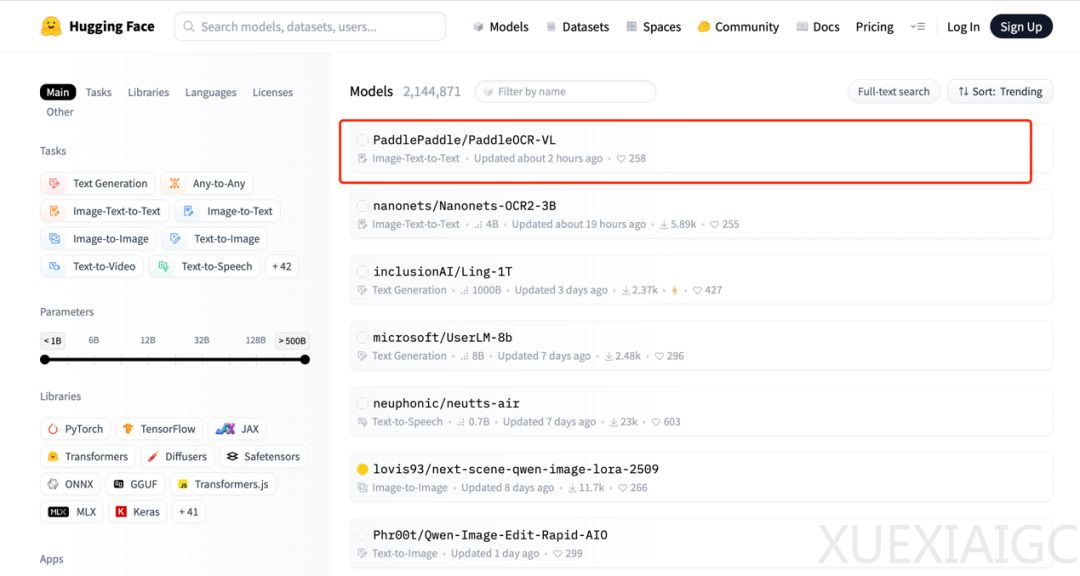

百度最新发布的自研多模态文档解析模型PaddleOCR-VL以0.9B轻量级参数量,在OmniDocBench V1.5榜单上以92.6分斩获全球综合性能第一。该模型在文本识别、公式识别、表格理解和阅读顺序四大核心能力上均刷新SOTA纪录,成为当前唯一实现四项能力全面领先的OCR-VL模型。发布16小时内即登顶Hugging Face全球趋势榜,其开源属性与个人设备友好性引发开发者广泛关注。

PaddleOCR-VL作为百度文心大模型体系的轻量化衍生产品,专为解决复杂文档结构解析难题设计。模型能精准处理PDF和图片中的逻辑结构、表格关系及数学表达式,支持109种语言识别,涵盖手写体、竖排版等传统OCR难以处理的场景。在真实测试中,面对折皱外卖单、古籍文献等极端案例,模型展现出超越人类平均水平的识别鲁棒性。技术架构上采用两阶段创新设计:PP-DocLayoutV2先行分析文档版面与阅读顺序,PaddleOCR-VL-0.9B随后完成细粒度识别,模块解耦策略使推理速度达1881token/s(A100),同时保持文本编辑距离0.035的行业顶尖精度。

模型突破性体现在四大维度:在文本识别单项取得96.5分,公式识别CDM值0.9453,表格理解得分89.8,阅读顺序预测误差仅0.043。测试显示其能完美解析含嵌套表格的财务报表、复杂Latex公式的学术论文,甚至10年前混排图文的技术文献。训练阶段使用超3000万样本构建多模态数据集,融合NaViT动态视觉编码器与ERNIE-4.5-0.3B语言模型,通过难例挖掘机制持续优化。实际应用中,模型可将柱状图等图表自动转换为结构化表格,为金融、政务等文档密集型行业提供端到端解决方案。

PaddleOCR-VL的诞生标志着OCR技术从”字符识别”向”语义理解”的范式转变。其以轻量架构超越Gemini-2.5 Pro、GPT-4o等巨模型的性能表现,验证了任务聚焦型设计的产业价值。作为文心4.5体系的关键拼图,该模型不仅提升RAG系统的知识抽取质量,更成为连接非结构化文档与AI认知的桥梁。百度通过这一创新,在全球多模态文档解析赛道首次确立中国标准,其开源策略将进一步加速技术生态的共建共享。

原文和模型

【原文链接】 阅读原文 [ 3337字 | 14分钟 ]

【原文作者】 量子位

【摘要模型】 deepseek/deepseek-v3-0324

【摘要评分】 ★★★★☆