文章摘要

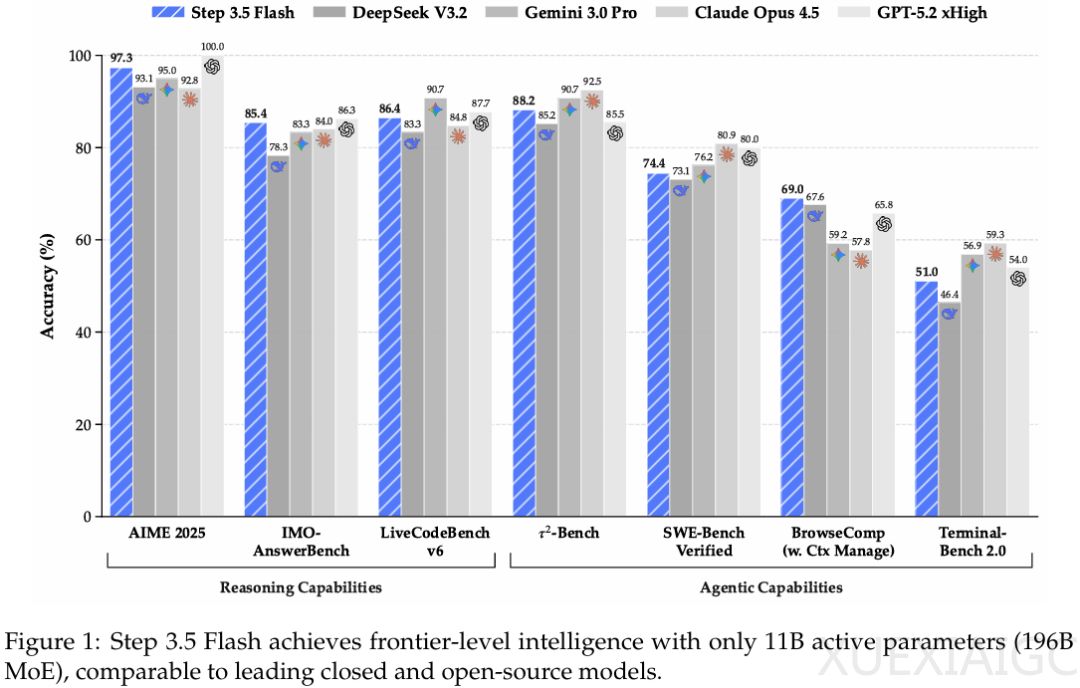

阶跃星辰发布目前最强模型Step 3.5 Flash,该模型为稀疏混合专家模型,拥有1960亿总参数、110亿激活参数,在复杂智能体任务上,性能与Gemini 3.0 Pro、Claude Opus 4.5、GPT-5.2 xHigh等前沿顶级大模型并驾齐驱,核心聚焦构建智能体所需的锐利推理与可靠执行能力,通过融合混合注意力机制与多Token预测技术降低长上下文交互延迟,辅以创新强化学习框架与分布式训练基建,在数学逻辑分析与代码编写领域表现突出。

研发团队设计模型时将效率与容量作为核心考量,采用滑动窗口注意力与全注意力按三比一比例交错排列的架构,引入多Token预测技术提升生成速度,通过增加查询头数量配合逐头门控注意力机制自动过滤无效信息,针对分布式部署的负载问题引入专家并行负载均衡策略,该参数高效设计在成本微幅上升的情况下,性能全面追平甚至超越全注意力基线模型,逐头门控机制也在各项基准测试中稳定优于传统固定接收Token方案。

该模型由4096张NVIDIA H800显卡组成的超级计算集群支撑训练,配套自研轻量级高性能Steptron训练框架,优化数据传输路径提升底层通信效率,内置高吞吐量轻量级监控服务器捕捉训练微小异常,通过激活值裁剪解决稀疏专家模型训练易出现的局部数值爆炸问题,最终完成17.2万亿Token的平顺训练;训练采用分阶段递进策略,逐步从开放领域基础预训练过渡到代码语料训练,上下文窗口从4000Token逐步扩展到12.8万Token,打磨模型超长上下文处理能力。

在监督微调后,团队针对性优化强化学习阶段,提出MIS-PO大都会独立采样过滤策略,采用二元过滤直接丢弃劣质轨迹提升训练稳定性,通过截断感知价值自举技术解决长文本长度截断带来的误判问题,将强化学习奖励拆分为处理可验证任务的RLVR和评估文本质量的RLHF两个独立系统;团队还打造了包含87.1万样本、总计72.3亿Token的高密度推理数据集,采用沙盒闭环训练提升工具调用稳健性,改用XML结构替代易出错的JSON格式,显著提升模型执行成功率。评测结果显示,仅110亿激活参数的该模型,在多项核心指标上追平甚至反超体量庞大数倍的竞争对手,在顶级逻辑测试与真实代码测试中均取得出色成绩。当前模型仍有提升空间,团队下一步计划优化算法压缩思考路径,提升专业化场景与超长对话的结构稳定性,这套技术方案让以极低算力成本实现前沿大模型性能成为可能。

原文和模型

【原文链接】 阅读原文 [ 2473字 | 10分钟 ]

【原文作者】 AIGC开放社区

【摘要模型】 doubao-seed-2-0-lite-260215

【摘要评分】 ★★★★☆