文章摘要

【关 键 词】 AI伦理、军事合作、OpenAI、价值分歧、离职潮

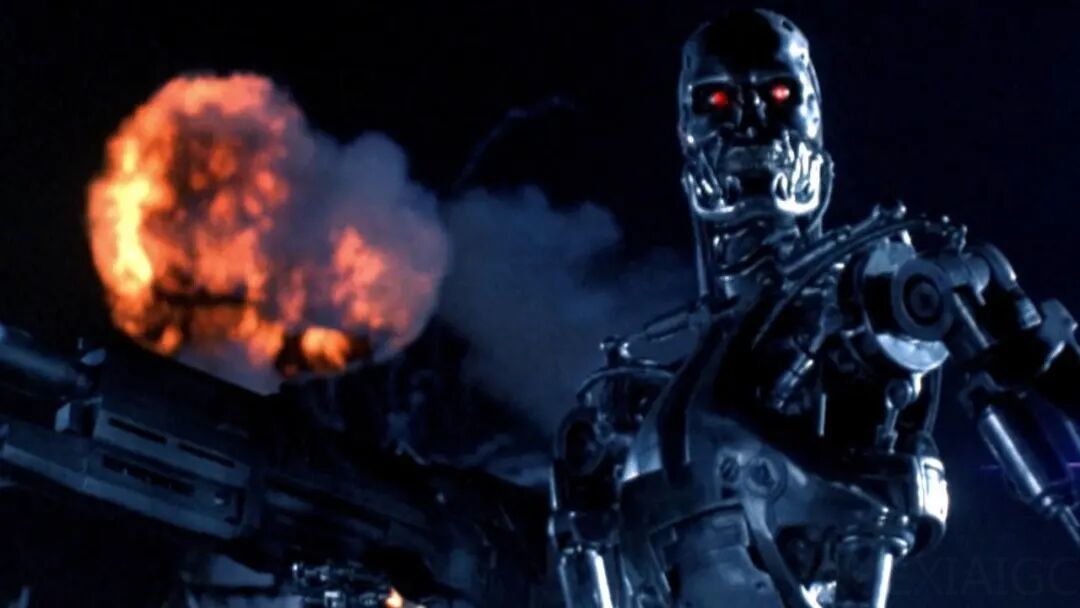

OpenAI硬件与机器人工程负责人Caitlin Kalinowski入职不到一年半,因无法接受OpenAI与美国国防部合作可能引发的国内监控和自主武器应用,宣布辞职。此前Anthropic拒绝了国防部提出的类似合作要求,因坚持写入更严格的伦理护栏被美国国防部长公开批评,并被特朗普政府下令停止合作,OpenAI随后接手了这笔生意。合作消息公布后引发公众强烈抵制,ChatGPT单日卸载量较前一日暴增295%,#QuitGPT运动三天内支持者超过250万,竞品Claude超越ChatGPT成为美国日均下载量第一的免费应用。迫于压力,OpenAI首席执行官Sam Altman承认推出合同过于仓促,宣布修订合同措辞,明确AI系统不应被故意用于对美国人员和公民的国内监控,但电子前沿基金会律师指出,加一个「故意」,并不等于真正的限制,情报与执法机构可借助偶然获取、商业购买的数据规避隐私保护限制。

作为给AI打造实体的研发负责人,Kalinowski面对的是比泛泛的伦理讨论更具体的问题,当OpenAI与国防部的合作从「模型使用」,延伸向未来可能的「具身AI军事应用」,Kalinowski的工作性质就变了。现有美国国防部政策不要求自主武器在使用武力前经过人工审批,乔治敦大学、牛津大学的相关专家分析后确认,修订后的合同既没有赋予OpenAI禁止政府军事用途的权利,也无法弥补AI驱动监控和自主武器在治理层面的结构性漏洞,在技术上并没有阻止其模型,成为「让GPT决定杀死某人」的系统的一部分。Kalinowski并非第一个因价值观分歧离开的人,OpenAI伦理团队和AI安全团队的离职率已经高达37%,多数离职者都明确表示无法接受AI用于军事用途,而这波离职潮正好发生在OpenAI快速扩张商业版图的阶段,公司刚刚扩额了与AWS的合作,预计2030年总收益将超2800亿美元。对比OpenAI的选择,Anthropic拒绝合作后虽然被政府暂停合作,但Claude的下载量逆势上升,某种程度上证明,「有原则的拒绝」在商业上并不一定是输家策略。

这一事件的意义远超个体离职,AI与军事结合是整个AI行业迟早要面对的选择,五角大楼持续释放合作需求,所有AI玩家都需要给出自己的答案。Altman试图通过修订合同措辞划定底线,但相关专家指出这类调整更多是公关层面的保护,而非技术层面的硬约束,当AI模型被部署进国防部保密网络,外界无法验证相关约束是否落地,透明度的缺失,本身就是最大的风险。Kalinowski没有发表公开批评,仅用辞职划出个人的伦理边界,也给全行业留下了值得思考的核心问题:你为自己造的东西,愿意负责到哪一步?

原文和模型

【原文链接】 阅读原文 [ 1963字 | 8分钟 ]

【原文作者】 极客公园

【摘要模型】 doubao-seed-2-0-lite-260215

【摘要评分】 ★★☆☆☆