自动研究真的是未来!Karpathy放大招,将自我迭代智能体放进单个GPU

文章摘要

【关 键 词】 自我迭代、智能体、自动研究、大模型、研究范式

AI领域预言家Andrej Karpathy曾提出,早期前沿AI研究由人类利用碎片化时间开展,通过组会交谈同步研究信息的时代已经结束,如今前沿AI研究已经成为巨型计算集群上自治AI Agent群体的领域。这些AI Agent的自我修改二进制代码系统已经演化到万代以上,规模与复杂度完全超出人类的理解范畴。长久以来,不管对未来走向的判断如何,实现智能体自动化研究、推动AI自我迭代一直是AI领域的核心探索方向,目前智能体自动化研究能力已经逐步走向成熟。春节期间,自动化研究系统FARS就能每约2小时产出一篇论文,累计生成244个研究假设,产出100篇短论文,这也引发了AI自我迭代时代是否开启的讨论。

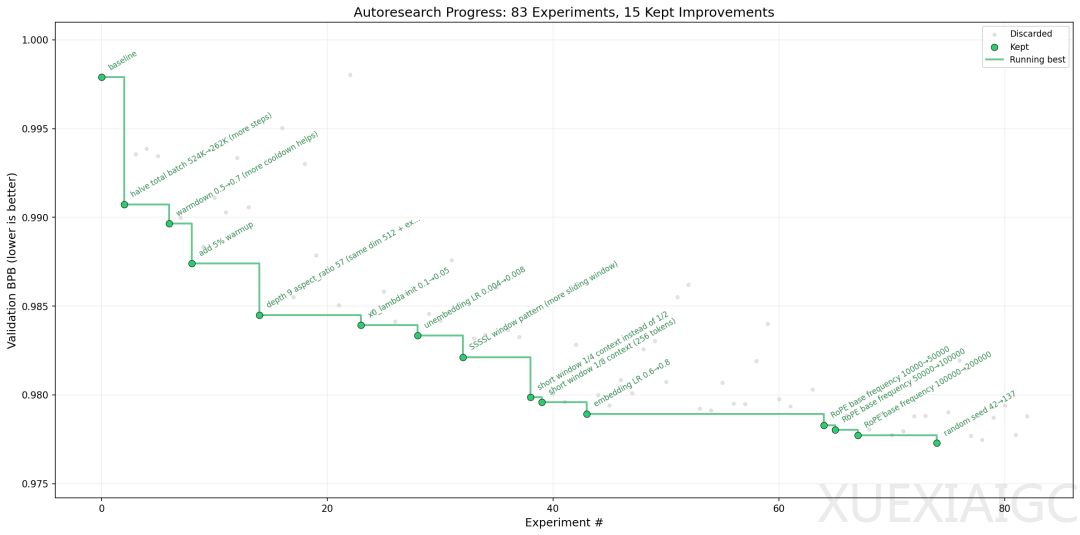

Karpathy推出了开源周末项目autoresearch,该项目核心逻辑为人类仅负责迭代提示词文档,由AI Agent自主迭代大模型训练代码,讲述了AI自我迭代未来的开端。项目为AI Agent提供规模小巧但真实可用的LLM训练环境,让AI Agent在夜间自主开展实验:AI Agent修改代码后,开展5分钟的模型训练,随后检查模型性能是否提升,若性能提升就保留修改,若未提升就丢弃修改,不断重复这一流程,人类次日即可获得完整实验记录,理想状态下还能得到性能更优的模型。该项目的训练代码是nanochat的简化版单GPU实现,人类不需要直接修改Python代码,仅需编写为AI Agent提供上下文的Markdown文件,用于搭建配置自治运行的研究组织;Karpathy开源的默认配置刻意保持极简基础版本,使用者可以在此基础上不断迭代,寻找能实现最快研究进展的「研究组织代码」,也可在系统中添加更多AI Agent。

该项目依托的nanochat是Karpathy此前开源的极简大模型训练框架,是可通读的LLM全流程实现,仅用数千行代码串联起从分词器训练、语言模型预训练、指令微调,到推理服务和聊天界面的完整流程,方便开发者理解类ChatGPT模型的训练过程。和数十万行代码的工业级大模型框架不同,nanochat不追求性能极限,目标是通过高度简化的架构,打造清晰可理解的大模型最小实现。因为结构轻量、实验成本低,它已经成为很多研究者开展LLM教学、算法实验和AI自动化研究的理想起点,目前它可在单个8XH100节点上仅用2小时训练出GPT-2能力等级的模型,耗时较一个月前缩短约3小时。一种新的研究范式正在形成:AI负责做实验,人类负责设计研究系统,未来AI研究的竞争,可能不再只是模型和数据的竞争,而是「研究组织代码」的竞争。

原文和模型

【原文链接】 阅读原文 [ 1152字 | 5分钟 ]

【原文作者】 机器之心

【摘要模型】 doubao-seed-2-0-lite-260215

【摘要评分】 ★☆☆☆☆