GPT之父Alec Radford新作:给大模型做「脑部手术」,危险知识重学成本暴增7000倍

文章摘要

【关 键 词】 模型安全、Token过滤、缩放定律、对抗韧性、认知突破

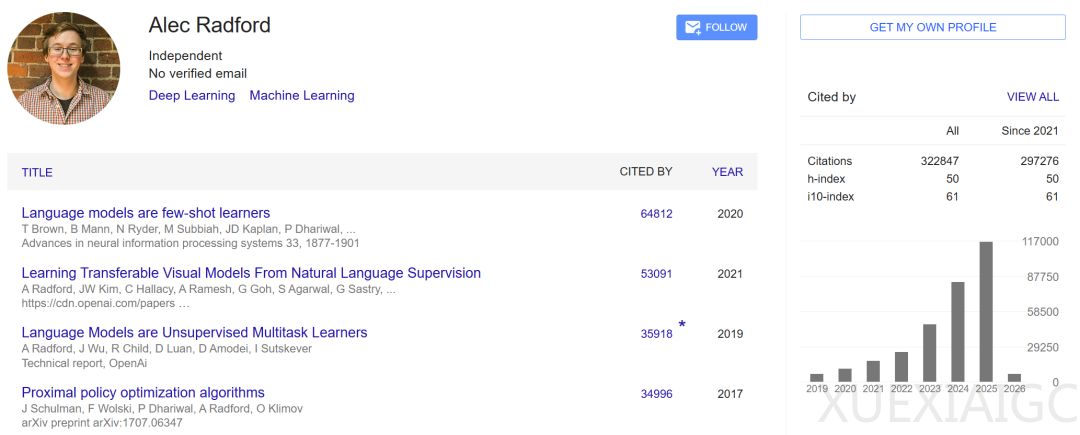

出生于1993年的独立研究员Alex Radford,作为GPT、GPT-2和CLIP等核心项目的第一作者,近期与Anthropic及斯坦福研究者Neil Rathi联合发布新研究,挑战大模型安全领域的核心假设。长期以来,业界普遍认为要在模型发布后通过RLHF或微调来限制其危险行为,但Neil Rathi和Alec Radford提出了一种更本质的解法:在预训练阶段,通过Token级别的数据过滤,直接从「大脑」深处切除危险知识。

当前减少大模型有害能力的主流方法多为事后干预,无论是RLHF还是机器遗忘,均是在模型掌握全部知识后添加“护栏”,存在易被攻击者“越狱”的安全隐患。而该研究主张从预训练阶段介入,通过调整训练数据让模型根本无法学到危险知识。实验选取高度重叠的医学知识(危险替身)与生物学知识(有益替身)为对象,验证方法可行性。

研究的核心创新在于Token级过滤机制,对比传统文档级过滤的粗糙与数据浪费,团队测试了损失掩码(忽略危险Token梯度)和移除(替换为< hidden >标记)两种策略。实验结果表明,Token级过滤构成了对文档级过滤的帕累托改进。在同等程度地去除医学知识的前提下,Token级过滤对生物学等通用知识的保留效果显著优于文档级过滤。

更关键的是,研究揭示了全新的Scaling Law:模型越大,这种过滤机制的效果越好。 对于18亿参数的模型,Token级过滤能使目标领域学习效率下降7000倍,攻击者恢复被删能力需付出极高算力代价。在对抗性微调测试中,经过Token级过滤预训练的模型表现出了极强的韧性。随着模型规模的增加,这种韧性优势还在不断扩大。对于18亿参数的模型,攻击者想要恢复同等水平的能力,面对Token移除策略模型所需的微调数据量是面对RMU机器遗忘模型的13倍以上。

此外,研究打破了AI安全领域的固有认知:为了让模型拒绝回答危险问题,模型并非必须先「知道」什么是危险的。 实验显示,经过Token级过滤的模型在拒绝训练中表现更优,Token移除策略模型的拒绝正确率比基线模型高出2倍,且不会像文档级过滤模型那样错误泛化拒绝行为。工程层面,团队提出基于稀疏自编码器的弱监督流程,这一发现极大地降低了该技术的落地门槛。开发者不需要拥有一支庞大的标注团队,仅凭现有的开源工具和小模型,就能构建出有效的预训练过滤器。

该研究倡导“纵深防御”策略,预训练Token级过滤为模型筑牢安全地基,其展现的Scaling Law有望成为未来AGI安全架构的关键组成部分。

原文和模型

【原文链接】 阅读原文 [ 2841字 | 12分钟 ]

【原文作者】 机器之心

【摘要模型】 doubao-seed-1-8-251228

【摘要评分】 ★★★★★