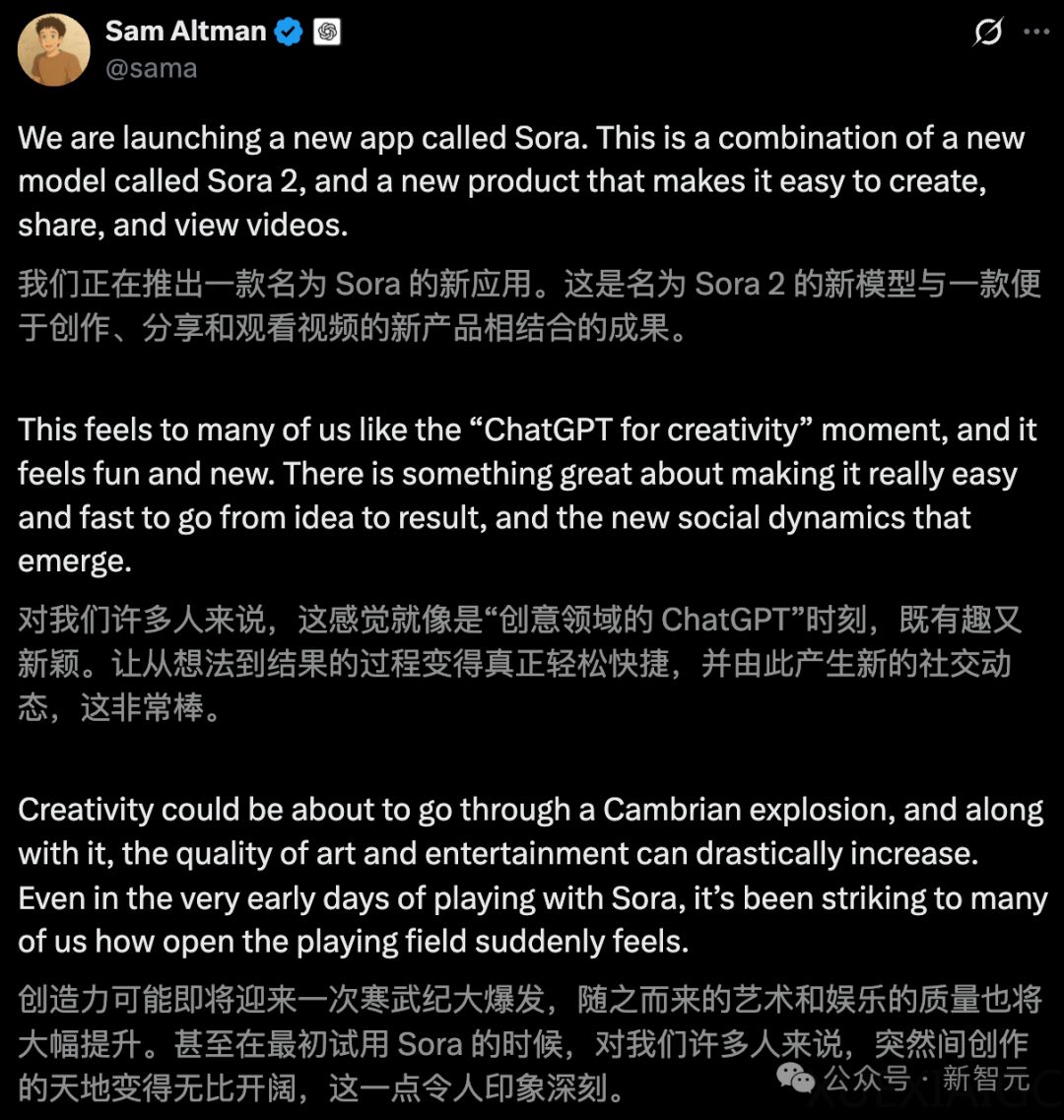

OpenAI Sora 2 登场!同步推出APP,Altman称这是创意领域的「ChatGPT 时刻」

文章摘要

【关 键 词】 AI视频、物理模拟、音画同步、社交互动、安全治理

OpenAI最新发布的Sora 2视频生成模型标志着AI视频技术进入全新阶段。该模型在物理准确性、画面逼真度和一致性上实现重大突破,首次实现音画同步生成,被业界称为”视频领域的GPT-3.5时刻”。通过海量视频数据训练,模型能够精确模拟物体运动轨迹、材质互动和力学原理,例如篮球投掷时会出现合理弹框或投偏,人物动作呈现真实惯性效果。

在技术层面,Sora 2解决了长期存在的多镜头连贯性问题。系统能保持场景状态记忆,确保角色服饰、环境光线等要素在镜头切换时保持逻辑一致。模型支持从写实到动漫的多种风格生成,并可精确控制镜头语言和叙事节奏。音频系统实现口型同步与动态环境音效,大幅降低后期制作成本。

创新性的”Sora App”推出社交互动功能,用户可通过身份验证将自己的形象”投射”到生成场景中。这项名为”Cameo”的技术支持用户与AI生成内容实时互动,开创了新型社交体验模式。分发算法侧重推荐具有二次创作价值的视频内容,而非传统短视频平台的被动消费模式。

在安全治理方面,OpenAI建立了多层防护机制。系统实施全流程内容审核,包括提示词过滤、生成内容分析和动态水印追踪。特别加强了对未成年人保护、肖像权管理和公众人物使用的限制。技术团队公布核心安全指标达到95-99%的拦截准确率。

Sora 2的突破不仅限于娱乐领域,其物理模拟能力为影视制作、教育演示乃至机器人训练提供了新可能。OpenAI表示将继续优化模型的世界模拟精度,同时呼吁行业共同应对AI生成内容带来的伦理挑战。该技术目前采用邀请制测试,计划逐步向专业用户和开发者开放API接口。

原文和模型

【原文链接】 阅读原文 [ 2818字 | 12分钟 ]

【原文作者】 Founder Park

【摘要模型】 deepseek/deepseek-v3-0324

【摘要评分】 ★★★★★