图灵奖得主Sutton新作:用一个1967年的公式,解决流式强化学习一大缺陷

文章摘要

【关 键 词】 深度强化、流式学习、意图更新、步长优化、在线适应

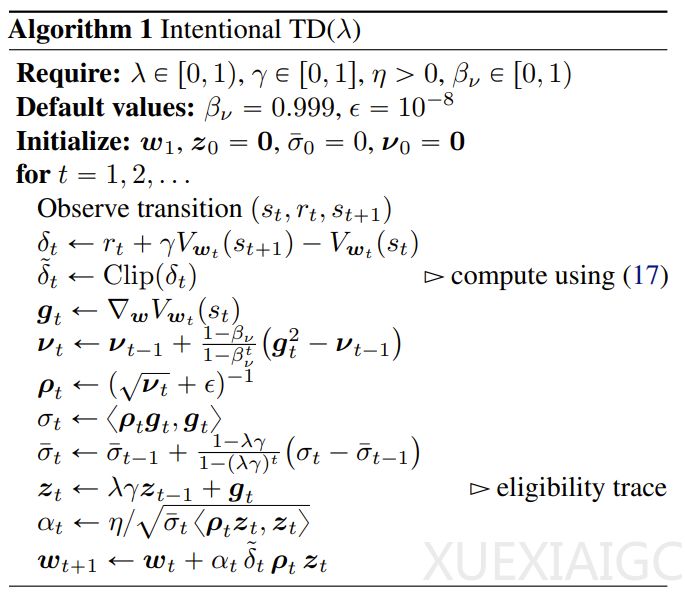

传统深度强化学习在移除回放缓冲区并采用单样本批量训练时极易崩溃,形成流式壁垒。研究表明,该困境的根本成因并非数据匮乏,而是传统梯度步长仅约束参数移动距离,缺乏对网络实际输出变化的精准控制。研究通过引入预期目标反向推算自适应步长的机制,强制每步更新实现预设的价值误差缩放或策略概率调整,有效遏制了单序列训练中的剧烈震荡趋势。

算法核心将更新步长设定为期望输出增量与梯度实际影响力的比值,辅以维度归一化与信号时序传播,构建出覆盖预测与决策场景的完整计算范式。基准测试数据证实,新算法在零历史回放配置下全面看齐采用庞大缓冲区的主流模型,单次迭代浮点运算开销大幅缩减,且实测输出变动严格收敛于设定阈值。辅助实验进一步印证,意图缩放逻辑自身即可保障训练稳定,系统对外部修正技巧的依赖显著降低。

架构在离散策略采样阶段仍面临步长依赖动作分布引发的隐式权重干扰,致使梯度期望方向出现阶段性偏离,构建动作无关的无偏更新策略已是明确的后续攻关目标。该技术方案凭借可量化的单步行为承诺,成功打破了海量数据批量堆砌与高算力集中的传统训练桎梏。面向资源受限边缘终端与长期动态环境控制,无需回放缓存的流式在线持续学习体系正展现出高度的理论成熟度与工程可行性。

原文和模型

【原文链接】 阅读原文 [ 2585字 | 11分钟 ]

【原文作者】 机器之心

【摘要模型】 qwen3.6-plus

【摘要评分】 ★★★★☆

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...