AGI焦点|OpenAI和英伟达,终究还是到了这一步

文章摘要

【关 键 词】 AI芯片、增长隐忧、AI泡沫、定制芯片、产业放缓

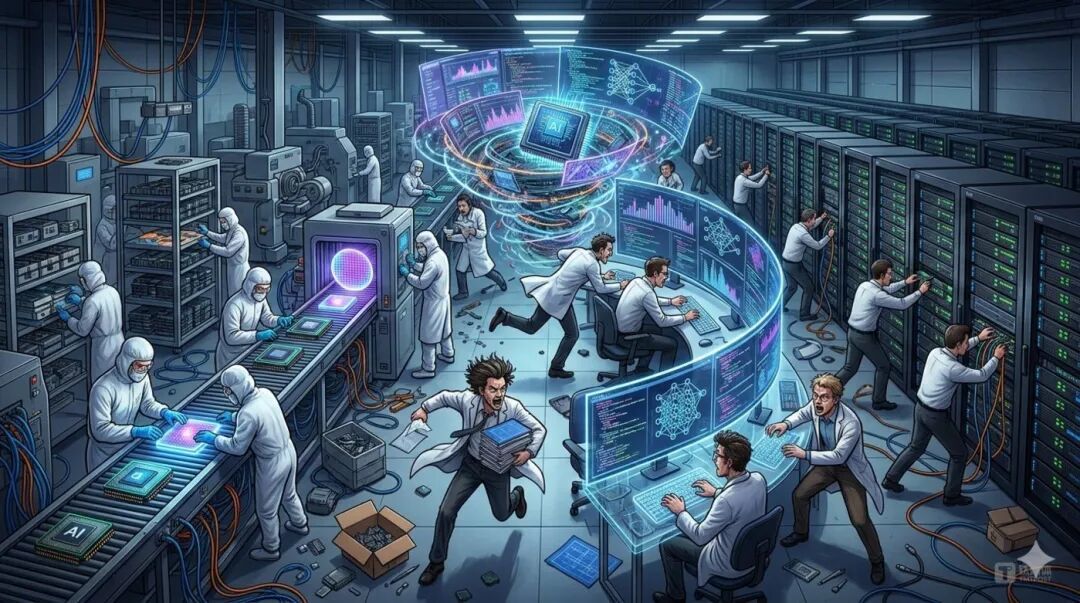

Meta、OpenAI、Anthropic等头部AI厂商今年签下数千亿美元芯片订单,芯片厂商因此获得巨额收益。ASIC芯片龙头博通2025年11月至2026年1月AI半导体收入达84亿美元,同比大涨106%,预计第二季度收入将进一步增至107亿美元,同比暴增143%,博通CEO预计明年公司AI芯片营收即可超过1000亿美元;英伟达同期业绩创下新纪录,总营收达681亿美元同比增长73%,且手握截至2026年底五个季度内至少5000亿美元的主力及下一代芯片订单,行业整体呈现狂飙突进的增长态势。

但繁荣背后已有约束隐现,支撑大模型发展多年的Scaling Law缩放定律和通用GPU的统治地位受到挑战,集中式的AI产业迅猛增长存在落潮风险。原本同为AI造浪者的英伟达与OpenAI合作关系明显松动,英伟达对OpenAI最新投资大幅缩水,黄仁勋明确表示此次投资可能是最后一次,此前规划的千亿美元合作大概率不了了之。这种转变背后是行业底层逻辑的变化:Scaling Law已出现触顶迹象,高质量结构化公开数据已被消耗殆尽,预训练阶段依靠数据和算力堆砌实现的性能跃迁难以再现。通用GPU领域同样遇到瓶颈,半导体先进制程演进速度明显放缓,摩尔定律放缓带动AI芯片性能增幅下滑,2018-2022年间AI芯片性能年均提升50%,2023-2025年已降至20%以下。

定制化ASIC芯片凭借特定场景性能优异、功耗更低、成本更优的优势强势崛起,开始冲击GPU的市场地位,谷歌TPU已经获得良好市场反馈,Meta、OpenAI等多家头部厂商都在加紧自研,预计2026年将迎来量产和商业化的集中爆发,通用硬件效率狂飙的阶段已经落幕。当前芯片与模型厂商陷入迭代速度赛跑,芯片迭代周期已从原来的18-24个月压缩至按年更新,仍跟不上大模型三个月一次的迭代速度,叠加制程、能源等硬性约束,可能引发增长动能断档,打破原有供需平衡。承担高额资本开支的云厂商压力最为突出,全球五大云厂商2026年资本开支总额将超过7000亿美元,远高于当前AI行业的整体年度经常性收入,且快速迭代让AI芯片实际折旧周期大幅缩短,业界对现有资本开支计算逻辑的质疑不断增多。Scaling Law退潮让资本开支狂飙失去合理性支撑,市场已对此给出负面反馈,云厂商股价、芯片企业估值纷纷承压,这也构成了当前AI泡沫论的核心焦虑。

目前行业仍维持高位的迭代速度和支出规模,高盛预测2025至2027年是AI服务器出货量增长最迅猛的三年,增速峰值出现在2026年,此后全产业链增长可能面临结构性放缓。2026年初多款AI Agent产品落地,直接展现了AI对人力的替代能力,相关替代危机的讨论引发广泛共鸣,为AI产业发展蒙上了一层不确定性阴影。(全文约760字)

原文和模型

【原文链接】 阅读原文 [ 2878字 | 12分钟 ]

【原文作者】 钛媒体AGI

【摘要模型】 doubao-seed-2-0-lite-260215

【摘要评分】 ★★★★☆