谷歌Gemini 1.5技术报告:轻松证明奥数题,Flash版比GPT-4 Turbo快5倍

文章摘要

【关 键 词】 多模态模型、技术报告、高性能、效率优化、应用潜力

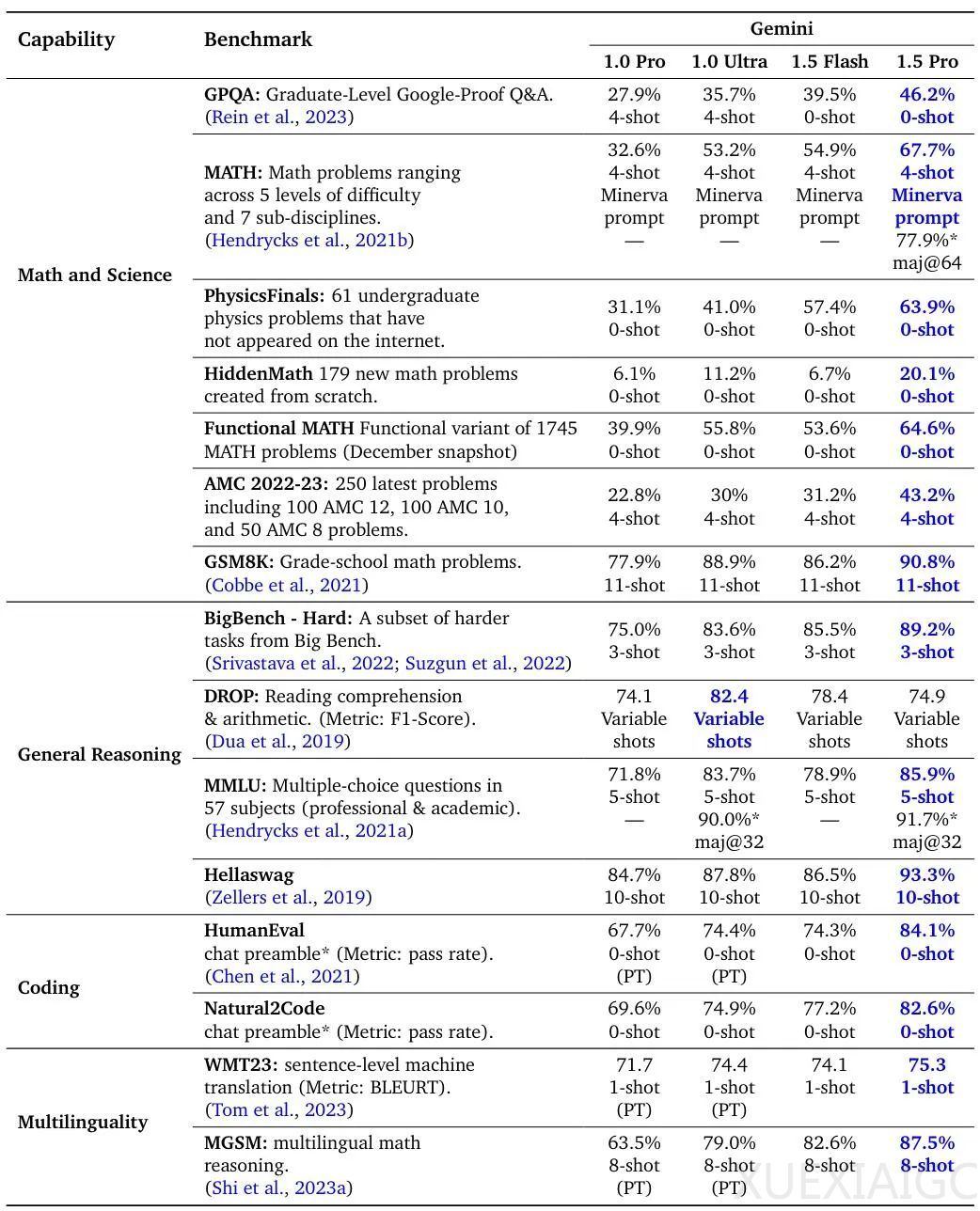

谷歌发布了Gemini 1.5系列多模态大模型的技术报告,该系列模型代表了高计算效率的下一代技术。报告指出,Gemini 1.5能够处理数百万token的上下文,并具备强大的推理能力,特别在处理跨模态内容上表现出色。该系列包括Gemini 1.5 Pro和Gemini 1.5 Flash两个新型号,其中Pro版在功能和基准测试上超过了之前的版本,而Flash版则是一种轻量级变体,专为提高效率设计,性能损失较小。

技术报告详细介绍了Flash模型,这是一个Transformer解码器模型,与Pro版具有相同的上下文和多模态功能,但优化了张量处理单元(TPU)的使用,并降低了模型服务延迟。该模型能够在多种语言的处理中实现最快的生成速度,并在多个基准测试中与Gemini 1.0 Pro和Ultra模型相比表现出色。

Gemini 1.5模型在跨模态长上下文检索任务上实现了近乎完美的召回率,并在长文档QA、长视频QA和长上下文ASR等领域提升了最优水平。报告还特别强调了Gemini 1.5 Pro在数学增强版本中的表现,它在竞赛级数学问题上表现优异,并在Hendryck的MATH基准测试中取得了突破性成绩。

此外,报告第七章节展示了 Gemini 1.5模型在实际应用中的潜力,例如与专业人士合作完成任务,以及在10个不同的工作类别中节省大量时间。模型还展示了一些独特的能力,如学习将英语翻译成使用人数极少的Kalamang语。

总结部分,Google DeepMind的副总裁兼Gemini项目联合负责人Oriol Vinyals指出,Gemini 1.5 Pro在性能上超越了Gemini 1.0 Ultra,而 Gemini 1.5 Flash则是目前最快的型号,其性能与Gemini 1.0 Ultra相当。研究显示, Gemini 1.5在与Claude 3.0和GPT-4 Turbo等现有模型的对比中实现了代际的飞跃。

原文和模型

【原文链接】 阅读原文 [ 1589字 | 7分钟 ]

【原文作者】 机器之心

【摘要模型】 glm-4

【摘要评分】 ★★★☆☆