文章摘要

【关 键 词】 Qwen2-Math、数学模型、AIGC、开源、推理能力

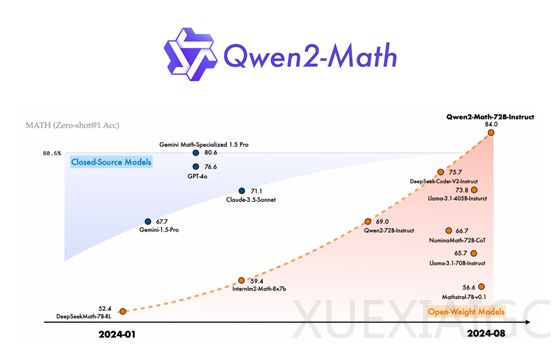

阿里巴巴集团开源了一款名为Qwen2-Math的最新数学模型,该模型包含1.5B、7B和72B三种参数规模的版本,旨在推动AIGC领域的专业社区发展。Qwen2-Math在多个数学基准测试中表现出色,特别是在72B参数规模的指令微调版本上,其性能超越了包括GPT-4o、Cloude-3.5-Sonnet、Gemini-1.5Pro以及Meta的Llama-3.1-405B等知名闭源模型。这一成就标志着Qwen2-Math-72B成为目前全球最强的数学推理大模型。

Qwen2-Math的基础模型版本在预训练阶段使用了Qwen2-1.5B、7B和72B进行初始化,并在高质量的数学专用语料库上进一步训练,该语料库包括数学网络文本、书籍、代码、考试题目以及由Qwen-2模型合成的数据。在英语和中国数学基准测试中,Qwen2-Math基础模型的性能均显著超越了Llama-3.1系列模型。

指令微调模型Qwen2-Math-72B采用了密集的奖励信号与二元信号结合的训练方法,通过拒绝采样方法构建SFT数据集,有效解决了复杂概率分布的采样问题。此外,模型还采用了GRPO强化学习算法进行优化,确保策略的持续改进。在英语和中文数学基准评测中,Qwen2-Math-72B指令微调模型在多个难度较高的数学测试中表现出色,包括OlympiadBench、CollegeMath、高考(GaoKao)、AIME2024、AMC2023以及中国2024年高考/中考数学题目。

值得注意的是,尽管Qwen2-Math模型目前仅支持英文,但阿里巴巴已表示将很快推出中英双语版本,以帮助更多用户开发生成式AI应用。此外,在预训练和微调数据集的处理过程中,阿里巴巴进行了去污染处理,确保了测试效果的准确性和公平性。

开源地址和GitHub链接分别为:https://huggingface.co/Qwen 和 https://github.com/QwenLM/Qwen2-Math?tab=readme-ov-file。这一开源举措有望进一步推动AIGC开发者生态的繁荣,为数学推理和AI技术的发展提供强有力的支持。

原文和模型

【原文链接】 阅读原文 [ 1103字 | 5分钟 ]

【原文作者】 AIGC开放社区

【摘要模型】 moonshot-v1-32k

【摘要评分】 ★★☆☆☆