文章摘要

近年大模型密集发布,虽在性能参数上持续优化,但底层架构的范式演进仍是技术发展的核心。行业已历经三大关键里程碑:通过内部思维链实现深度计算的推理范式、自训练初期即联合处理多种数据的原生多模态方案,以及在预训练阶段强化任务拆解与工具自主调用的架构升级。在此技术背景下,SenseNova U1 作为原生理解与生成统一模型,展现了显著的突破路径。该模型采用全新设计的底层网络,彻底移除了传统的视觉编码器与数据重构模块,直接在系统内部构建了涵盖像素特征与高层语义的统一表征空间。

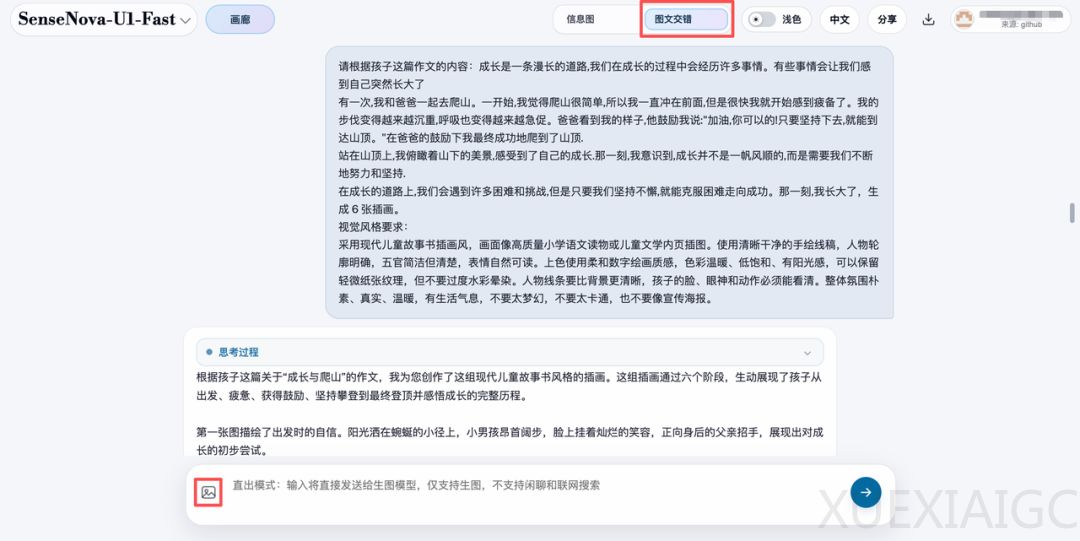

相较于当前普遍依赖独立识别组件加中间转译的混合建模方案,新设计有效规避了离散化重编码过程中的细节丢失。以往多模态方案的运行逻辑仍高度绑定文本底座进行图像转述,导致空间关系弱化与视觉失真。统一表征机制使得原始视觉信息能够无缝介入核心推理流程,确保了跨模态数据在计算链条中的完整性。该架构同时打通了理解与创作的模块隔离,无需调用外部图像引擎即可完成从内容解析到视觉生成的端到端链路。轻量化版本的实测表明,系统已稳定实现长文本解析与图文混排图表生成的协同操作。

此项架构革新将直接重塑复杂内容自动化的工作流形态。在处理文档编排或演示材料构建时,模型能够基于全局阅读语境自主决策视觉节点配比,确保产出素材与原始叙事在逻辑与风格上保持高度连贯。该单一体化处理机制彻底消解了传统多模块拼接中必然出现的上下文断裂与语义割裂问题。尽管方案在生成稳定性与视觉精细化层面仍需持续优化,但其设计方向已明确后续迭代路径。多模态理解与原生生成的深度整合预计将在短期内确立为头部产品的标准架构与行业新共识。

原文和模型

【原文链接】 阅读原文 [ 2451字 | 10分钟 ]

【原文作者】 AI产品阿颖

【摘要模型】 qwen3.6-plus-2026-04-02

【摘要评分】 ★★★☆☆