文章摘要

【关 键 词】 光计算、光电融合、算力瓶颈、芯片架构、产业应用

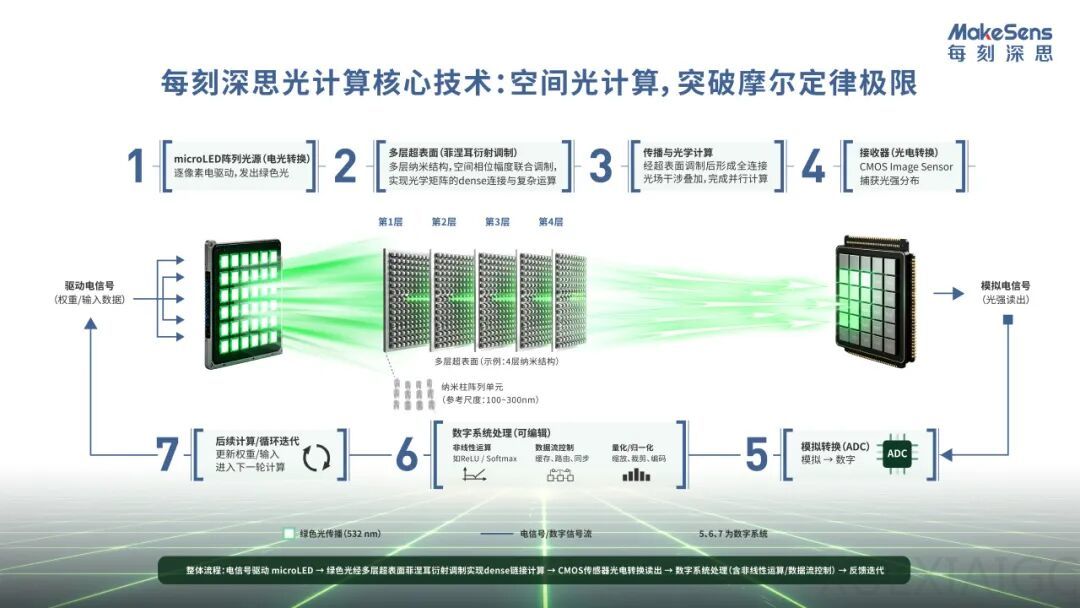

传统电计算体系在人工智能大模型带来的指数级算力需求下,正逐步逼近物理能耗极限。过去数十年依赖堆叠电子元器件的优化路径已难以突破热力学天花板,算力效率的进一步提升面临严峻挑战。光电融合计算凭借极低静态能耗、超高带宽及接近光速传输的低延迟特性,成为突破当前计算架构物理天花板的核心方向。纯光计算因数据输入输出与交互控制体系仍高度依赖电子系统,难以独立构建完整生态,因此产业技术共识已明确转向光与电深度协同的架构分工。技术团队创新性地提出在模拟信号域直接完成光电协同计算的路径,有效规避了传统多次模数转换与光电物理接口带来的性能损耗。通过采用基于超表面的空间光计算方案,系统可实现高维度矩阵的大规模并行运算,其计算规模与集成密度显著优于传统波导路线,相关原型验证已在特定任务中展现出相较现有商用芯片数量级的能效跨越。

在商业化推进层面,该技术路线优先聚焦人工智能推理应用场景,充分利用模型参数固化与计算链路固定的特征,大幅削减高频数据搬运环节的能量开销。系统级评估表明,该架构整体部署成本有望压降至传统图形处理器方案的十分之一,同时实现百倍级能效提升与纳秒级延迟响应。采用成熟半导体工艺研发的高性能芯片已逐步攻克大规模算法复用与光电链路全链条打通的工程难题,即将启动产业级规模化测试。尽管当前方案仍需持续攻关运算并发规模、算法动态适应性及计算精度等工程环节,但核心器件制造良率已突破关键阈值。未来算力基础设施的竞争重心将从制程微缩转向单位能耗效率的极致压榨,光电融合计算阵列的实质落地不仅划定了电子算力的物理补充边界,更将重塑人工智能时代的底层算力成本函数,为高并发智算中心的集约化部署提供高效率技术路径。

原文和模型

【原文链接】 阅读原文 [ 2586字 | 11分钟 ]

【原文作者】 半导体行业观察

【摘要模型】 qwen3.6-plus-2026-04-02

【摘要评分】 ★★★☆☆