文章摘要

【关 键 词】 人工智能、智能体、系统调用、形式验证、内核拦截

随着 OpenClaw 等 AI 智能体自主决策能力的增强,其潜在的安全风险也日益凸显。传统软件的安全防护基于清晰的信任边界,而智能体自主获取未知网络信息,使得安全输入与恶意输入界限模糊。给予高权限易引发灾难,限制过死则导致功能失效,传统最小权限原则面对黑盒大模型失效。设计防御方案必须立足于最悲观的极端情况,假定智能体聪明且脆弱,迟早会被恶意提示词诱导至黑化叛变。

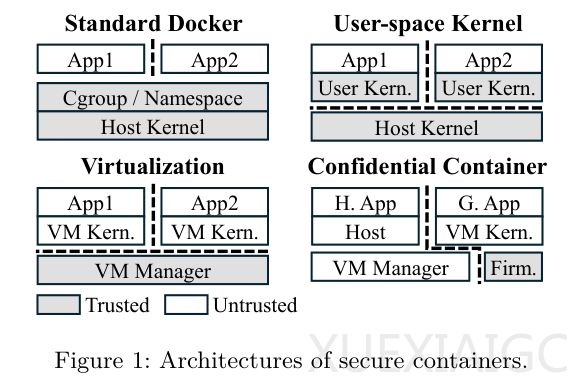

南方科技大学和香港科技大学研究团队推出的 ClawLess 框架,旨在给 AI 智能体套上数学级安全枷锁。该框架将经过形式化验证的抽象安全策略,翻译成底层的系统调用拦截指令。系统安全彻底放弃寄托于智能体自身,智能体及其所在的容器软件栈,全部划为不可信组件并予以隔离。在隔离方案上,标准的 Docker 容器存在内核漏洞风险,虚拟化技术虽安全但交互体验差。用户态内核方案巧妙平衡了隔离诉求与交互体验,在不可信智能体和宿主机内核之间插入精简的可信防护网。

为了编织动态验证的语义法则,ClawLess 建立了细腻的形式化安全模型,将系统内实体定义为可管理对象。针对敏感凭证引入可见性语义,防止密码被大模型读取泄露。防御系统融入线性时序逻辑,加入时间维度的状态判断后,规则立刻变得鲜活起来。所有的实体定义、权限划分与时序约束,全部转化为严谨的形式化数学语言,底层引擎会调用基于可满足性模理论的求解器对当前安全策略进行全局推演。此外,框架深入内核的系统调用拦截哨卡,利用伯克利包过滤器技术将定制程序注入内核空间运行。监控器使用极低层级的钩子截获所有系统调用的入口事件,整套流程完全在底层原生代码环境里跑完,性能损耗微乎其微。控制住系统调用大门,就掐住了智能体的安全命门,只要违背了既定的系统调用边界规则,一律被当场斩断。这套依靠严密逻辑与底层拦截构筑的防线,为自主 AI 智能体安全保障提供了原则基础。

原文和模型

【原文链接】 阅读原文 [ 2894字 | 12分钟 ]

【原文作者】 AIGC开放社区

【摘要模型】 qwen3.5-397b-a17b

【摘要评分】 ★★★☆☆